ShaderToy常见代码解释 (收录中)

在编程这一方面, 个人认同这一个观点: 要想实现某个东西最有效的办法是抄别人的代码, 并且要抄得明白.

不要看这句话看似很 low, 它里面其实有这么一些对应关系, "抄得明白"对应知道原理, "抄别人代码"对应实践.

对于 ShaderToy 也是一样的, 你想像那些前辈一样实现酷炫的效果, 就得脸皮厚一点去 抄明白 他们的代码, 大胆承认抄别人的代码.

想做到 抄明白, 得了解代码使用了哪些知识, 这些知识就像是积木一样, 我们要做的利用这些积木搭出自己想要的东西,

这里就是专门介绍这些常用的积木, 它们基本上是数学知识, 主要是线性代数, 微积分以及概率论的这三个方面,

当然, 使用代码实现数学内容少不了数值分析这一门学问, 另外还包含一些数字信号处理和图像处理的的知识.

但是本文并不是要成为数学的入门课, 而是学习如何用它们解决图形上的一些问题, 同时尽量会说明引用了什么数学定理,

方便读者(包括我本人)遇到不会的数学知识可以自行去搜索学习, 尽可能地给初学者提供一个系统的入门指南.

这里有很多内容来自于 The Book of Shaders 这本书(截止目前为止还没写完), 以及 Inigo Quilez 的文章,

相当一部分来自于 The Art of Code 频道, 少部分参考了 Programming Tricks in ShaderToy / GLSL.

Inigo Quilez 的文章要求读者有前面提到的数学基础, 所以读不懂不要气馁, 等掌握了基础再来读即可.

有很多时候需要作图以及计算等式, 所以个人建议最后学一两个这方面的工具,

简单作图的话推荐 GraphToy, 想要作一些复杂的图以及公式计算则推荐 Maxima.

另外, 如果你不喜欢在 ShaderToy 上编码而是喜欢本地进行实验, 那么推荐使用 glslViewer,

和 glslViewer 的差别基本在于内置 Uniforms 名字不太一样, 并且比其 ShaderToy 还支持更高版本的 GLSL,

你想更加全面得接触 GLSL 那么 glslViewer 更好.

推荐完工具后就是个人的数学学习心得了 (仅供参考, 不作标准), 个人认为学数学应 尽可能 地对给出定理刨根问底, 具体做法是:

理解定理 \(P\) 的证明思路, 知道每一个证明步骤是以哪些定理/公理作为根据, 所以在这个过程中可能也会遇到一些陌生的定理 \(L\),

如果定理 \(L\) 的定义影响到你对定理 \(P\) 证明的理解, 那么以同样做法去理解定理 \(L\) 的证明思路, 再回过头来接着理解定理 \(P\) 的证明;

否则就默认定理 \(L\) 是正确的, 继续理解定理 \(P\) 的证明.

简单来说, 学数学是一个递归过程, 这就会为什么数学里存在公理且公理是不可证明的, 因为不可能一直刨根问底的.

理解定理的证明思路, 是为了理解定理诞生的动机及思想, 只有这样避免死记硬背, 为后面的运用自如打下基础.

复杂理论最初必定是源自一个简单的想法, 不过想找到这个简单想法可不简单.

最后就是对于知识的运用, 当到了知道哪些知识可以解决什么问题, 以及看到问题可以联想到用哪些知识解决, 就说明到达运用自如的地步了,

而在遇到一些从未见过的新问题时, 也能联想到使用哪些知识进行分析和解决, 到了这一个地步就极有可能发掘出知识的新用法,

而这种程度的联想就是人们口中的灵感,也是人们口中天才的特质.

想要到达运用自如的境界需要经常练习, 以及找出知识与知识之间的联系, 就比如多元函数的梯度向量与导数与法线向量三者之间的联系.

所以说, 学数学依靠的是耐心和理解.

你可能会有异议, 天赋就不重要了吗?

我的理由是: 每个人对天赋的定义是不统一的, 也就是天赋缺乏良定义, 学习的一个重要原则是不能使用有歧义的概念去描述问题.

对于抄代码也一样, 先找出这段代码背后是哪些知识原理, 解决什么类型的问题, 然后抄到形成条件反射随手就能写出来的程度,

但严谨死记硬背, 抄到即便别人写法不太一样但也能马上看出来是抄过的代码, 抄到明白每一个参数变量的作用, 可以按照自己的意愿对代码进行调整.

当基础知识足够扎实时, 应该就有能力实现 Advances in Real-Time Rendering in 3D Graphics and Games 里面的技术了.

常见的困惑

GLSL 矩阵储存方式

默认情况下, GLSL 使用列优先储存矩阵. 假设这是一个用于左乘的矩阵: \(\left( \begin{array}{c} a & b \\ c & d \end{array} \right)\),

那么在 GLSL 里应该这么定义:

mat2(a, c,

b, d);

常见的 UV 计算

UV - 计算片元在屏幕上所对应的 UV 坐标

写于 2024/3/3

OpenGL 的 UV 坐标是一个左下角为原点, 向上为 \(U\), 向右为 \(V\), 且范围都是 \([0, 1]\) 的坐标系.

在 ShaderToy 中, 人们把整个画面看作是一张大贴图, 片元就是该大贴图上面的一个纹理像素(texel).

片元理所当然地有一个 UV 坐标, 可以通过片元坐标 \(gl\_FragCoord\) 和屏幕分辨率 \(iResolution\) 计算出来.

默认情况下, \(gl\_FragCoord\) 假设左下角为屏幕坐标系的原点, 以及以像素的中心为像素原点.

vec2 uv = gl_FragCoord.xy / iResolution.xy; // [0.0, 1.0]

当要注意的是, 为了方便作图, 片元的 UV 并非就要固定在 \([0.0, 1.0]\) 之间.

有时候为了实现某些目的, 需要对 UV 做一些列变换.

比如把纹理坐标空间的原点从左下角平移到中心,

vec2 uv = (gl_FragCoord.xy / iResolution.xy) - 0.5; // [-0.5, 0.5]

这一步开始已经把一个屏幕平均分成 4 份了.

\([-0.5, 0.5]\) 分别在 \(u\) 和 \(v\) 两个方向上分为 \([-0.5, 0]\) 和 \([0, 0.5]\) 两个区间.

因此, \(2 \times 2 = 4\) 份.

把新的纹理坐标空间的范围拓展到 \([-1.0, 1.0]\),

vec2 uv = 2.0 * ((gl_FragCoord.xy / iResolution.xy) - 0.5); // [-1.0, 1.0] // 可简化成 vec2 uv = 2.0 * (gl_FragCoord.xy / iResolution.xy) - 1.0;

到目前为止, 我们的 UV 计算都是针对屏幕分辨率比例是一比一的情况.

在非一比一情况下绘制个圆形会导致圆变椭圆, 这是因为 \(UV\) 两分量的范围比例和屏幕分辨率比例对不上, 导致出现拉伸的情况.

解决方法很简单, 以屏幕分辨率比例为准, 对 \(UV\) 长的那一方维度分量进行补偿, 使得 \(UV\) 分量的范围比例和屏幕分辨率比例一致.

原本的 \(UV\) 范围比例固定是 \(\frac{x_{uv}}{y_{uv}} = 1\), 而屏幕分辨率比例是 \(\frac{x_{iResolution}}{y_{iResolution}}\),

如果屏幕是 \(X\) 轴比较长, 那么 \(UV\) 就要针对 \(x\) 分量进行补偿才能和屏幕分辨率一致: \(\frac{x_{uv} \times \frac{x_{iResolution}}{y_{iResolution}}}{x_{uv}} = 1 \times \frac{x_{iResolution}}{y_{iResolution}} = \frac{x_{iResolution}}{y_{iResolution}}\),

如果屏幕是 \(Y\) 轴比较长, 那么 \(UV\) 就要针对 \(y\) 分量进行补偿才能和屏幕分辨率一致: \(\frac{x_{uv}}{y_{uv} \times \frac{y_{iResolution}}{x_{iResolution}}} = 1 \div \frac{y_{iResolution}}{x_{iResolution}} = \frac{x_{iResolution}}{y_{iResolution}}\).

你可能会问既然要保证两者比例一样, 为什么还要讨论哪根轴较长呢?

从公式上来看, 如果 \(Y\) 比较长的话, 用 \(1 \times \frac{x_{iResolution}}{y_{iResolution}}\) 来计算不也是一样可以保证两者比例一致吗?

但是别忘记了 \(UV\) 本身就是依赖 \(iResolution\) 计算出来的, 因此这个数字 \(1\) 本身就依赖于 \(iResolution\), 下面的代码可以证明这点.

vec2 uv = 2.0 * (gl_FragCoord.xy / iResolution.xy) - 1.0; // [-1.0, 1.0] if (iResolution.x > iResolution.y) { // 如果屏幕的 X 轴比 Y 轴长 uv.x *= iResolution.x / iResolution.y; } else { // 如果屏幕的 Y 轴比 X 轴长, 或两者相等 uv.y *= iResolution.y / iResolution.x; }

到目前为止我相信大部分人都能看得懂, 但 ShaderToy 上的例子大部分都是把这段代码简化成一句的.

现在来逐个分析,

vec2 uv = 2.0 * (gl_FragCoord.xy / iResolution.xy) - 1.0; /* 等同于 uv = (2.0 * gl_FragCoord.xy) / iResolution.xy - iResolution.xy / iResolution.xy uv = (2.0 * gl_FragCoord.xy - iResolution.xy) / iResolution.xy 同时可以拆开来看 uv.x = (2.0 * gl_FragCoord.x - iResolution.x) / iResolution.x uv.y = (2.0 * gl_FragCoord.y - iResolution.y) / iResolution.y */ if (iResolution.x > iResolution.y) { // 如果屏幕的 X 轴比 Y 轴长 uv.x *= iResolution.x / iResolution.y; /* 等同于 uv.x = (2.0 * gl_FragCoord.x - iResolution.x) / iResolution.x * iResolution.x / iResolution.y uv.x = (2.0 * gl_FragCoord.x - iResolution.x) / iResolution.y 如果和 y 分量合并一起计算, 那么就是 uv = (2.0 * gl_FragCoord.xy - iResolution.xy) / iResolution.y */ } else { // 如果屏幕的 Y 轴比 X 轴长, 或两者相等 uv.y *= iResolution.y / iResolution.x; /* 等同于 uv.y = (2.0 * gl_FragCoord.y - iResolution.y) / iResolution.y * iResolution.y / iResolution.x uv.y = (2.0 * gl_FragCoord.y - iResolution.y) / iResolution.x 如果和 x 分量合并一起计算, 那么就是 uv = (2.0 * gl_FragCoord.xy - iResolution.xy) / iResolution.x */ } /* 综合两种情况来看就是 uv = (2.0 * gl_FragCoord.xy - iResolution.xy) / min(iResolution.x, iResolution.y) */

所以, ShaderToy 上有不少例子都是有这一句(或类似的).

vec2 uv = (2.0 * gl_FragCoord.xy - iResolution.xy) / min(iResolution.x, iResolution.y);

在大部分的 ShaderToy 例子中, UV 计算是基础且重要的东西, 这个小节所介绍的 UV 计算其实是 UV 补偿, 解决画面拉伸的问题.

还会介绍一些其它的 UV 计算来实现不同的效果.

UV计算 - 平铺(tiling)

这里的平铺就是和计算机的桌面壁纸里的平铺是一个概念: 当一张壁纸不能把桌面铺满, 那么就用重复若干张壁纸铺满桌面.

Shader 编程也可以平铺.

我们可以换个角度来思考, 默认情况下, 一个像素所对应 \(UV\) 坐标是 gl_FragCoord.xy / iResolution.xy, 分量的范围是 \([0, 1]\), 这是针对与整个屏幕来说的.

想要平铺, 我们只要在屏幕的范围内复制多几个 \([0, 1]\) 范围的 \(UV\) 坐标空间就好了.

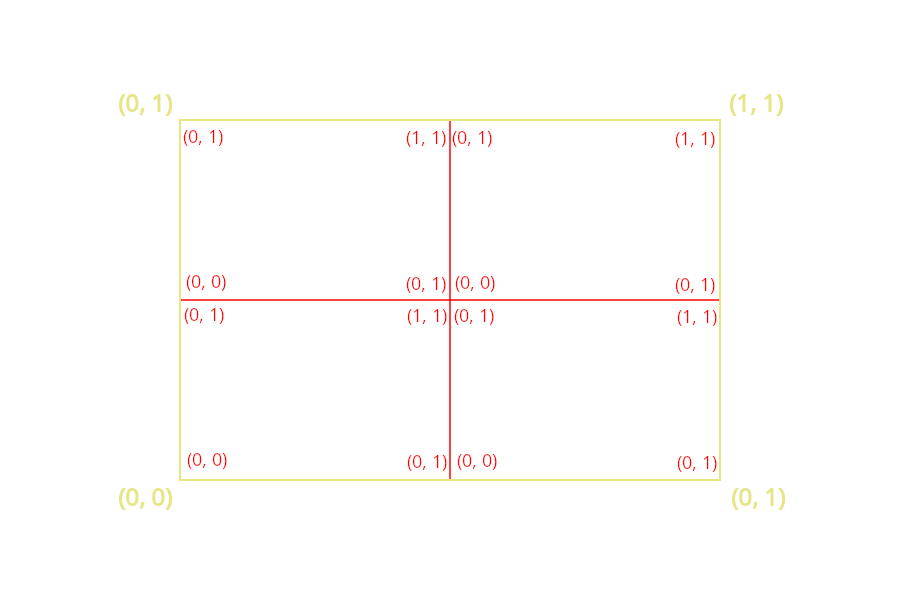

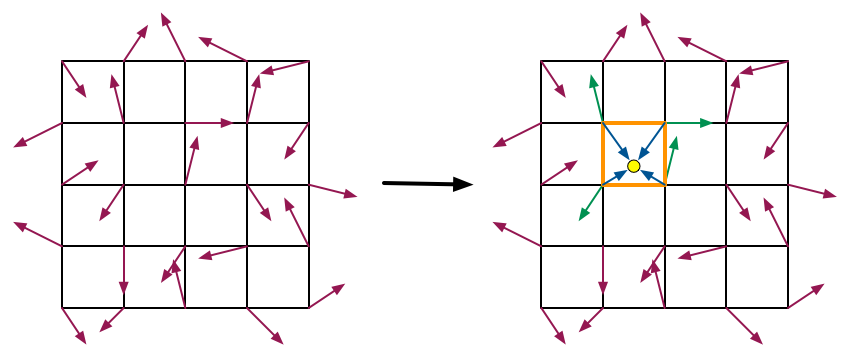

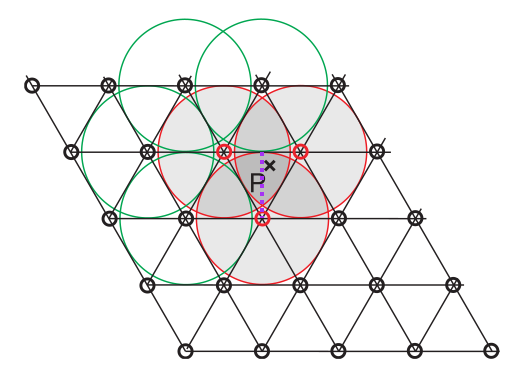

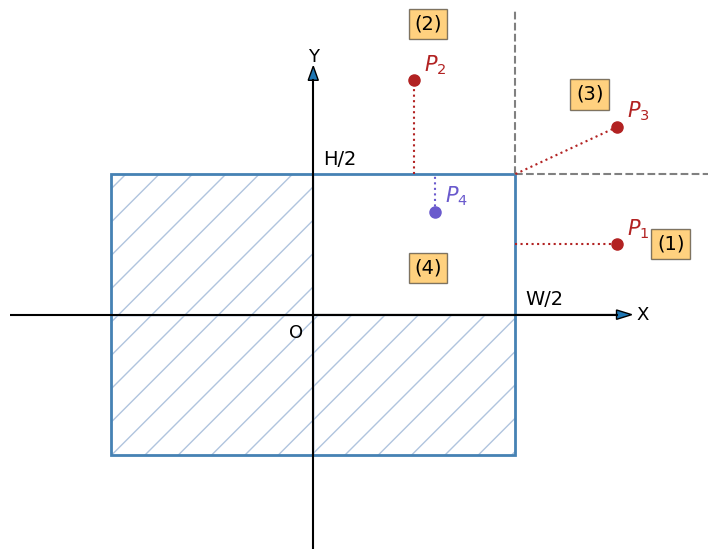

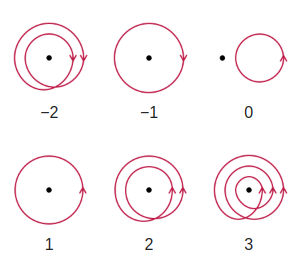

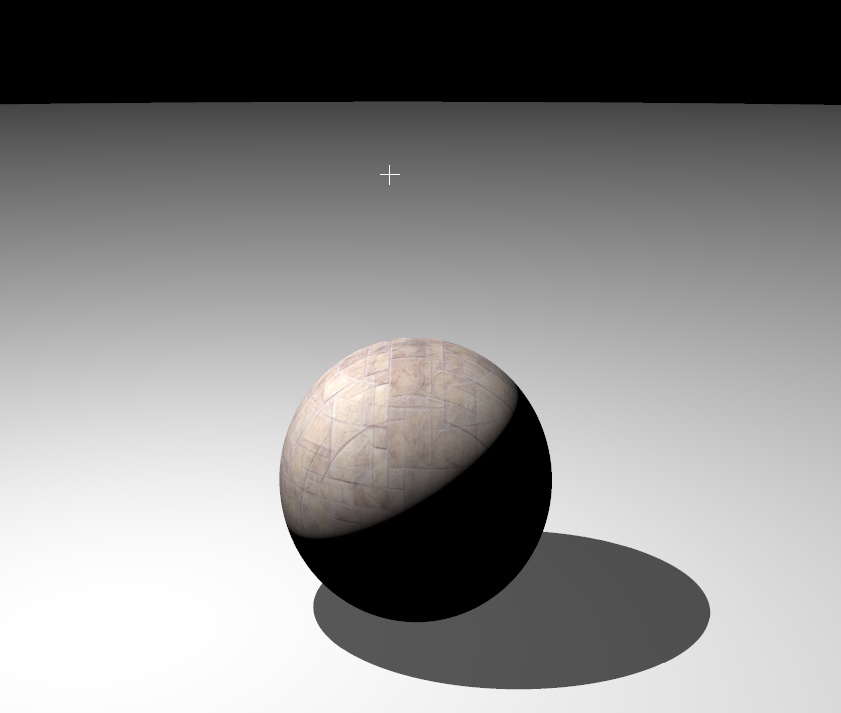

Figure 1: 重复了 4 个 \([0, 1]\) 范围的 \(UV\) 坐标空间

话虽如此, 具体应该怎么做呢? 虽然没有标准答案, 但还是有基本法的.

从原本映射关系来看是 \([x_{min}, x_{max}] \rightarrow [0, 1]\) 和 \([y_{min}, y_{max}] \rightarrow [0, 1]\),

想要在更小的屏幕范围内应该一个 \(UV\) 空间, 只要改变 \(x_{max}\) 和 \(y_{max}\) 的值就可以了.

对于看左上角的 \(UV\) 空间, 可以通过 gl_FragCoord.xy / (iResolution.xy / 2), 这里就是把 \(x_{max}\) 和 \(y_{max}\) 分别改变为 iResolution.x / 2 和 iResolution.y / 2.

接下来的问题就是如何让构造出另外三个 \(UV\) 空间呢?

因为当 gl_FragCoord.x 超出 iResolution.x / 2 时, gl_FragCoord.x / (iResolution.x / 2) 的值就是大于 1 的浮点数,

我们的目标是让其它三个 \(UV\) 空间的分量范围为 \([0, 1]\), 方法很简单, glsl 的内置函数 fract 可以获取浮点数的小数部分,

比如 fract(1.1) 等于 0.1, fract(2.1) 也是等于 0.1, 从而形成一个以 0 到 0.999… (没到 1) 为一个周期的周期序列.

其实可以把第下一个周期头部的 0 看作是上一个周期的 1.

原因很简单, 假设现在经过划分得到两个周期, 那么

fract(x)会得到这样的一个序列(, 以 0.1 为步长):

[0, 0.1, 0.2, ..., 0.9], [0(1), 0.1, 0.2, ..., 0.9], 0(2)

这样就可以让其它 \(UV\) 空间的分量范围也处于 \([0, 1)\) 之间,

综上所述, \(UV\) 的计算方式就变成这样:

float div_num = 2.0; vec2 uv = fract(gl_FragCoord.xy / (iResolution.xy / div_num)); // 又或者 vec2 uv = fract(gl_FragCoord.xy / iResolution.xy * div_num); // 不同方向轴运用不同倍率的平铺 vec2 div_nums = vec2(10.0, 2.0); vec2 uv = fract(gl_FragCoord.xy / iResolution.xy * div_nums);

这并非唯一的方法, 只要是周期函数都可以获取周期序列来进行平铺, 比如 cosine, sine 和 modulo, 等等.

cosine 和 sine 的用法和 fract 差不多, 在替换 fract 时要控制好周期:

#define PI 3.14 float div_num = 2.0; float period = 2.0 * PI; // 别忘记控制好周期 vec2 uv = cos(gl_FragCoord.xy / (iResolution.xy / div_num * period)); // 又或者 vec2 uv = cos(gl_FragCoord.xy / iResolution.xy * div_num * period);

模运算(modulo)有一点不同:

float div_num = 2.0; float period = 1.0; vec2 uv = mod(gl_FragCoord.xy / (iResolution.xy / div_num), period); // 又或者 vec2 uv = mod(gl_FragCoord.xy / iResolution.xy * div_num, period);

模运算的周期可以用来对 \(UV\) 空间进行等比缩放, 如果把 period 定义为 2.0, 那么 \(UV\) 的分量范围就是 \([0, 2]\).

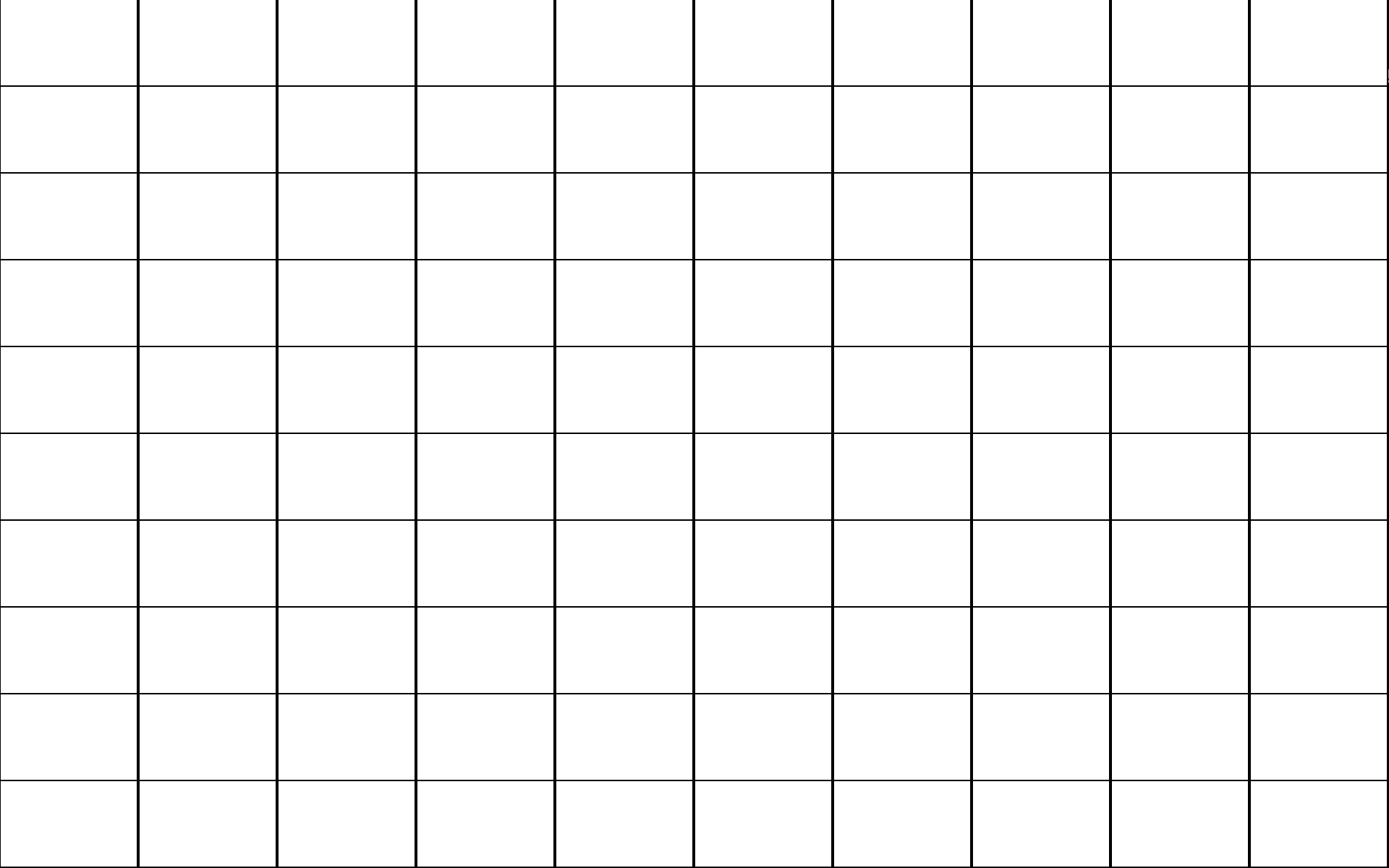

UV格子可视化

有时候为了方便调试可以把 UV 格子绘制出来,

// 绘制网格 float grid(vec2 uv, vec2 xRange, vec2 yRange) { // xRange 和 yRange 分别是 uv.x 和 uv.y 分量的范围 // xRange.x 是 xMin, xRange.y 是 xMax, yRange.x 是 yMin, yRange.y 是 yMax // 控制格子线粗 float xThickness = 0.01, yThickness = 0.01; // 通过计算片元的分量与其取值范围两端之间的距离, 如果小于一定值, 那么片元在格子边缘上, 用 0 表示片元在边缘上 float distX = any(lessThanEqual(abs(uv.x - xRange), vec2(yThickness))) ? 0.0 : 1.0; float distY = any(lessThanEqual(abs(uv.y - yRange), vec2(xThickness))) ? 0.0 : 1.0; // Opt2: 绘制柔化一点的格子线条 // vec2 distXs = smoothstep(vec2(0.0), vec2(yThickness), abs(uv.x - xRange)); // vec2 distYs = smoothstep(vec2(0.0), vec2(xThickness), abs(uv.y - yRange)); // float distX = min(distXs.x, distXs.y); // float distY = min(distYs.x, distYs.y); return distX * distY; } // 以下为为例子 void main() { vec2 uv = gl_FragCoord.xy / iResolution.xy; uv.xy *= 10; uv.y = 10 - uv.y; uv = fract(uv); // 网格索引, 比如 (1.1, 2.3) -> (1.0, 2.0), 可以有其它用途 vec2 uvId = floor(uv); // 想要整型向量可以使用 ivec2 uvId = ivec2(uv); float g = gird(uv, vec2(0.0, 1.0), vec2(0.0, 1.0)); vec3 lineColor = vec3(0.0); vec3 ogColor = vec3(1.0); // 原图颜色 vec3 color = mix(lineColor, ogColor, g); // 在颜色线条与原图颜色之间进行切换 gl_FragColor = vec4(color, 1.); }

这个例子可以在学习完 函数 - smoothstep 以及 函数 - mix 才回头细读.

Figure 2: \(10 \times 10\) 网格

GLSL 内置函数

函数 - smoothstep

从这里开始的后面几个章节都会介绍一些常用(或者一些光看名字不知道做啥)的

GLSL内置函数, 不过并不会介绍一些典型的数学函数, 比如sin/cos/atan这些,这些直接去看数学书就好, 介绍它们会拉长笔记的篇幅.

这些内置函数均可用在

Fragment Shader中.

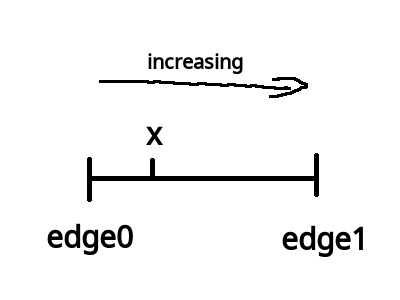

\(smoothstep\) 函数的定义等价如下:

/* genType clamp(genType x, genType minValue, genType maxValue) equals min(max(x, minValue), maxValue) */ genType smoothstep(genType edge0, genType edge1, genType x) { genType t = clamp((x - edge0) / (edge1 - edge0), 0.0, 1.0); return t * t * (3.0 - 2.0 * t); }

\(t\) 是从 \(edge0\) 到 \(edge1\) 的插值, 结果在 \([0, 1.0]\) 内.

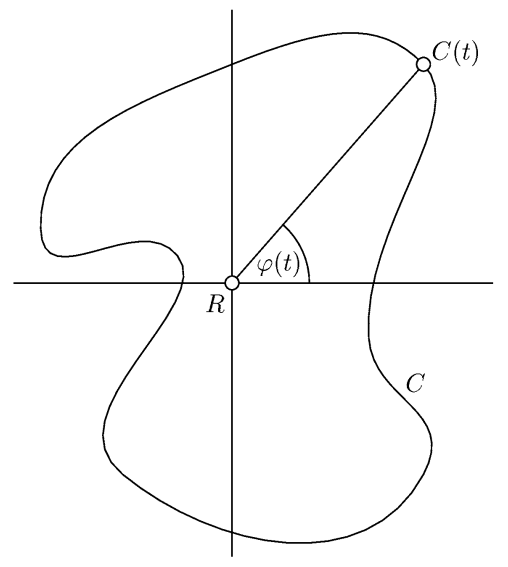

Figure 3: x, edge0 以及 edge1 三者的关系

\(smoothstep\) 的返回值 \(f(t) = 3t^{2} - 2t^{3}\) 是一个最高次项为 3 的多项式函数,

其一阶导数为 \(f^{'}(t) = 6t - 6t^{2} = 6t(1 - t)\), 令 \(f^{'}(t) = 0\) 可以求得两个驻点的 \(t\) 分量: \(0\) 和 \(1\).

再求出二阶导数 \(f^{''}(t) = 6 - 12t\), 分别把驻点的 \(t\) 分量分别代入到其中, 分别得到 \(f^{''}(0) = 6 > 0\) 和 \(f^{''}(1) = -6 < 0\).

也就是说函数 \(f(t)\) 在 \(t = 0\) 为极小值, 在 \(t = 1\) 为极大值, \(t\) 在 \([0, 1]\) 这个区间内是单调递增的.

又刚好 \(t \in [0, 1.0]\), 因此, \(f(t)\) 最小值为 \(f(0) = 0\), 最大值为 \(f(1) = 1\).

我们再令 \(f^{''}(t) = 0\) 尝试求出函数 \(f(t)\) 在 \([0, 1]\) 区间的拐点, 解得 \(t = 0.5\).

把 \(t = 0.5\) 代入原函数得到 \(f(t=0.5) = 3 \times 0.5^{2} - 2 \times 0.5^{3} = 0.5\), 得到拐点 \((0.5, 0.5)\).

最后求该点处的切线: \(k = f^{'}(0.5) = \frac{y - 0.5}{x - 0.5} = 1.5 \rightarrow y = 1.5x - 0.25\).

该切线的导数 \(k^{'} = 1.5\), 表明了函数 \(f(t)\) 在 \(t = 0.5\) 处的斜率的变化率(也就是 \(f^{''}(t)\))是在逐渐增加,

在 \(t = 0.5\) 的左边 \(f^{''}(t) > 0\) (函数图像 \(f\) 在 \(x = 0.5\) 左边为上凹), 在右边则是 \(f^{''}(t) < 0\) (函数 \(f\) 在 \(x = 5\) 的右边为下凹). 因此, 点 \((0.5, 0.5)\) 的确是拐点.

因此, \(smoothstep\) 是一个从 \([edge0, edge1]\) 到 \([0, 1]\) 的映射, 一条变化率为先增后减的曲线.

最终的函数图像如下:

如果仔细看文档的话你会发现一句: "Results are undefined if edge0 ≥ edge1".

然而实践发现: \(edge0 \gt edge1\) 的时候,

GraphToy所绘制的 \(smoothstep\) 函数图像表面依然是有结果的.比如, 你可以尝试把上面的 \(smoothstep(0.0, 1, x)\) 换成 \(smoothstep(1, 0.0, x)\) 观察一下: 函数图像会镜像翻转, 从 1 到 0 之间进行插值.

经过搜索, 发现在 GLSL 1.10 中 \(smoothstep\) 是没有这一句的, 这一句是从 GLSL 1.20 开始才有的.

目前不确定这一句是不是只对一些新版本的

GLSL生效, 还是说有些GLSL的实现没有严格按照标准来.其实在数学层面来看, \(edge0 \ge edge1\) 不会导致函数

undefined的, 目前实践下来也没有出现undefined的情况.

The Book Of Shaders 的 smoothstep 函数绘制 Shader 解析

#ifdef GL_ES precision mediump float; #endif #define PI 3.14159265359 float plot(vec2 st, float pct) { return smoothstep(pct-0.02, pct, st.y) - smoothstep(pct, pct+0.02, st.y); } void main() { vec2 st = gl_FragCoord.xy / iResolution; // smooth interpolation between 0.1 and 0.9 float y = smoothstep(0.1, 0.9, st.x); vec3 color = vec3(y); float pct = plot(st, y); color = (1.0 - pct) * color + pct * vec3(0.0, 1.0, 0.0); gl_FragColor = vec4(color, 1.0); }

这段 shader 的算法做的事情很简单: 绘制出 \(smoothstep(0.1, 0.9, x)\) 的函数图.

实现很简单: 首先计算出 \(st.x\) 经过 \(smoothstep(0.1, 0.9, x)\) 映射后的值 \(y\), 但这样的话所有 \(x\) 分量相同的片元在经过映射后拥有相同的 \(y\), 我们需要判断片元是否处于函数上.

\(plot\) 函数就是判断片元是否在函数上的.

上面代码中的 \(plot\) 函数其实是优化过了的, 先看未经优化的版本:

在计算出经过映射的 \(y\) 后, 对片元的 \(y\) 分量和映射 \(y\) 进行对比, 如果两者相等就说明片元在函数上.

但由于它们两者都是浮点数, 没法直接判断是否相等, 因此只能认为当两者相差小于一个边界时为相等.

float plot(vec2 st, float pct) { return abs(pct - st.y) < 0.01 ? 1.0: 0.0; /* 或者使用 step 函数 step(abs(pct - st.y), 0.01); type = float/vec2/vec3/vec4 type step(type edge, type x) equals returnValue[i] = edge[i] > x[i] ? 0.0: 1.0; */ // return step(abs(pct - st.y), 0.01) ? 1.0: 0.0; }

不过 这样绘制出来的函数图像很生硬, 边界有锯齿, 过渡不够平滑(, 改节标题连接上面的代码可以修改看效果).

优化后的 \(plot\) 函数就是为了解决过渡不平滑的问题而出现的:

\(smoothstep(pct-0.02, pct, st.y)\) 的函数图像是 \(smoothstep(0.02, pct+0.02, st.y)\) 图像的左平移, 在水平方向上两者相差 \(0.02 \times 2\) 个距离.

在 \([ptc-0.02, pct+0.02]\) 区间的某一个位置上, 两个图像 在垂直方向上 相差的距离的变化规律是先增后减少, \(0.02\) 决定着变化率, 越大变化越小, 线条越粗.

如果稍微了解过微积分的话, 应该能感觉相差距离的变化正好符合 \(smoothstep\) 导数的行为, 事实上 plot 就是一个蕴含了求近似导数的步骤.

我们也可以使用

Maxima进行绘图,Maxima是一个CAS软件, 除了能画图以外还能帮助你进行强大的数学运算.个人十分推荐掌握这个工具.

/* 定义 smoothstep 函数 */ smoothstep(l, u, x) := block( t: min(max((x - l) / (u - l), 0.0), 1.0), return (t * t * (3 - 2 * t)) )$ /* 绘图 */ plot2d([smoothstep(0.1-0.5, 0.1, x), smoothstep(0.1, 0.1+0.5, x), smoothstep(0.1-0.5, 0.1, x) - smoothstep(0.1, 0.1+0.5, x) ], [x, -2, 2]);

通过 \(smoothstep(0.1-0.5, 0.1, x) - smoothstep(0.1, 0.1+0.5, x)\) 的图像可以得知, 优化后的 \(plot\) 的变化相对平滑一点.

回到优化后的 \(plot\) 上, 它的作用就是让 \(st.y\) 在 \([y-0.02, y+0.02]\) 范围内进行插值, 以先增后减的变化率返回 \([0, 1]\) 的值, 而不是像未优化版只返回 \(0\) 或 \(1\) 那样一刀切.

ShaderToy 的编程思路总结

刚开始接触 ShaderToy 的代码时, 我只知道最终目的是为了设置片元的颜色,

但并不知道如何绘制出自己想要的图像. 即便把其中用到的数学知识都掌握了,

但仍然不知道作者是如何把这些知识有机地整合在一起的.

在阅读了一定数量的作品后, 发现了它们都遵守了同一个模式, 而这个模式正是我想要的答案.

以下是个人对该模式的粗略总结和见解:

- 计算当前片元

UV坐标 \(\mathrm{uv}_0 = \mathrm{gl\_FragCoord.xy} / \mathrm{iResolution.xy}\); 对

UV坐标进行变换 \(f_1\) 得到新UV坐标 \(\mathrm{uv}_1 = f(\mathrm{uv}_0)\), 根据 \(\mathrm{uv}_1\) 计算出片元颜色.像前面 常见的UV计算 就是一种变换, 比如让

UV分量的范围变为 \([-0.5, 0.5]\), 因此 \(f_1(\mathrm{uv}) = \mathrm{uv} - \mathrm{vec2}(0.5, 0.5)\).实际开发通常有 \(n\) 个变换步骤:

\(\mathrm{uv}_1 = f_{1}(\mathrm{uv}_{0})\)

\(\Downarrow\)

\(\mathrm{uv}_{2} = f_{2}(\mathrm{uv}_{1})\)

\(\Downarrow\)

\(\mathrm{uv}_{3} = f_{3}(\mathrm{uv}_{2})\)

\(\vdots\)

\(\mathrm{uv}_{n} = f_{n}(\mathrm{uv}_{n-1})\)

确定好每一个函数 \(f_i\) (1 ≤ i ≤ n) 的输入和输出范围, 并对 \(f_i\) 的连续性/变化/极值有良好的了解;

第一点可以通过 区间运算(interval arithmetic) 进行估算, 第二点要求开发者有一定的微积分基础,

特别是多元标量值函数以及多元向量值函数有了解, 有时候为了定义想要的函数 \(f_i\), 还需要掌握一点概率论.

上面的模型其实不太全面, \(f_i\) 并非一定要以向量作为输入和输出, 可以向量作为输入以标量作为输出,

也可以标量作为输入以向量作为输出, 或者以标量作为输入和输出, 这取决于具体需求.

由于

ShaderToy不提供几何数据, 这导致片元只有UV坐标一个属性,因此,

ShaderToy代码通常情况下会以UV坐标作为 主要 变换对象, 自然 \(f_i\) 就以向量作为输入;但在通常的

3D项目中, 片元除了UV坐标还会有一大堆几何数据, 这些数据既有向量也有标量,UV通常不再是 主要 变换对象了, 所以 \(f_i\) 的形式是不太固定的.思考如何定义函数 \(f\).

这里举例两种常见的思考方式.

颜色随着位置的变化该如何变化

往 \(y\) 方向增加, 颜色越亮, 往 \(x\) 方向增加, 颜色越亮.

vec2 st = gl_FragCoord.xy / iResolution; // f(st) = st.x + st.y // y 增加, color 增加 // x 增加, color 增加 float color = clamp((st.x + st.y) * 0.5, 0.0, 1.0); gl_FragColor = vec4(vec3(color), 1.0);

Figure 4: 越往右上角方向越亮

改图的变化可以使用微积分进行分析得到, 变换的定义为一个二元标量值函数: \(f(u, v) = 0.5 \times (u + v)\),

它的梯度向量为 \(\nabla f(u, v) = (0.5, 0.5)\), 梯度向量是 \(f\) 增长最快的方向,

这就是为什么往右上角方向走越来越亮, 分别计算出水平/垂直/右上角方向的方向导数:

\(\begin{cases}(0.5, 0.5) \cdot (1.0, 0.0) = 0.5 \\ (0.5, 0.5) \cdot (0.0, 1.0) = 0.5 \\ (0.5, 0.5) \cdot \frac{(1.0, 1.0)}{\sqrt{2}} \approx 0.707 \end{cases}\)

对比可以发现, 它们之间的大小关系正好反应了在不同方向上的变化趋势.

这个例子中的 \(f(u, v)\) 是线性函数, 只凭想象来就能思考变化规律.

然而, 对于非线性函数来凭想象就不是那么容易了, 所以借助绘图软快速绘制等值曲线(contour curves)来了解变化是一个不错的手段.

这里用

Maxima来演示绘制 \(f(x, y) = x^{2} - y^{2} - 10\) 在 \(x,y \in [-1, 1]\) 的等值线图,/* 曲面图 + 等值线图 */ draw3d( xlabel = "x", ylabel = "y", zlabel = "z", contour = both, contour_levels = 15, surface_hide = true, enhanced3d = true, explicit(x^2 - y^2, x, -1, 1, y, -1, 1) )$

Figure 5:

曲面图 + 等值线图/* 曲面图 + 等值线图 + 灰阶 */ draw3d( xlabel = "x", ylabel = "y", zlabel = "z", contour = both, contour_levels = 15, surface_hide = true, enhanced3d = true, palette = gray, explicit(x^2 - y^2 - 10, x, -1, 1, y, -1, 1) )$

Figure 6:

曲面图 + 等值线图 + 灰阶/* 在曲面上绘制等值线图 */ draw3d( xlabel = "x", ylabel = "y", zlabel = "z", contour = both, contour_levels = 15, surface_hide = true, explicit(x^2 - y^2 - 10, x, -1, 1, y, -1, 1) )$

Figure 7:

曲面图附加等值线 + 等值线图/* 等值线图 + 灰阶 (个人偏向用这个, 效果图如下) */ draw3d( xlabel = "x", ylabel = "y", view = map, enhanced3d=true, palette = gray, explicit(x^2 - y^2 - 10, x, -1, 1, y, -1, 1) )$

Figure 8:

等值线图 + 灰阶关于

Maxima更多的绘图选项请自行阅读文档.对于在函数 \(f\) 上的片元应该赋予什么颜色, 在函数外的片元又该赋予什么颜色.

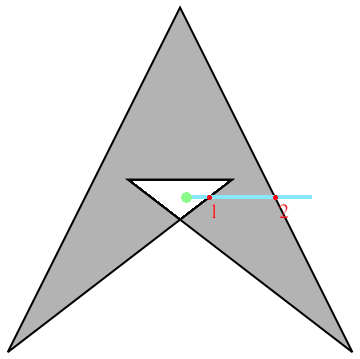

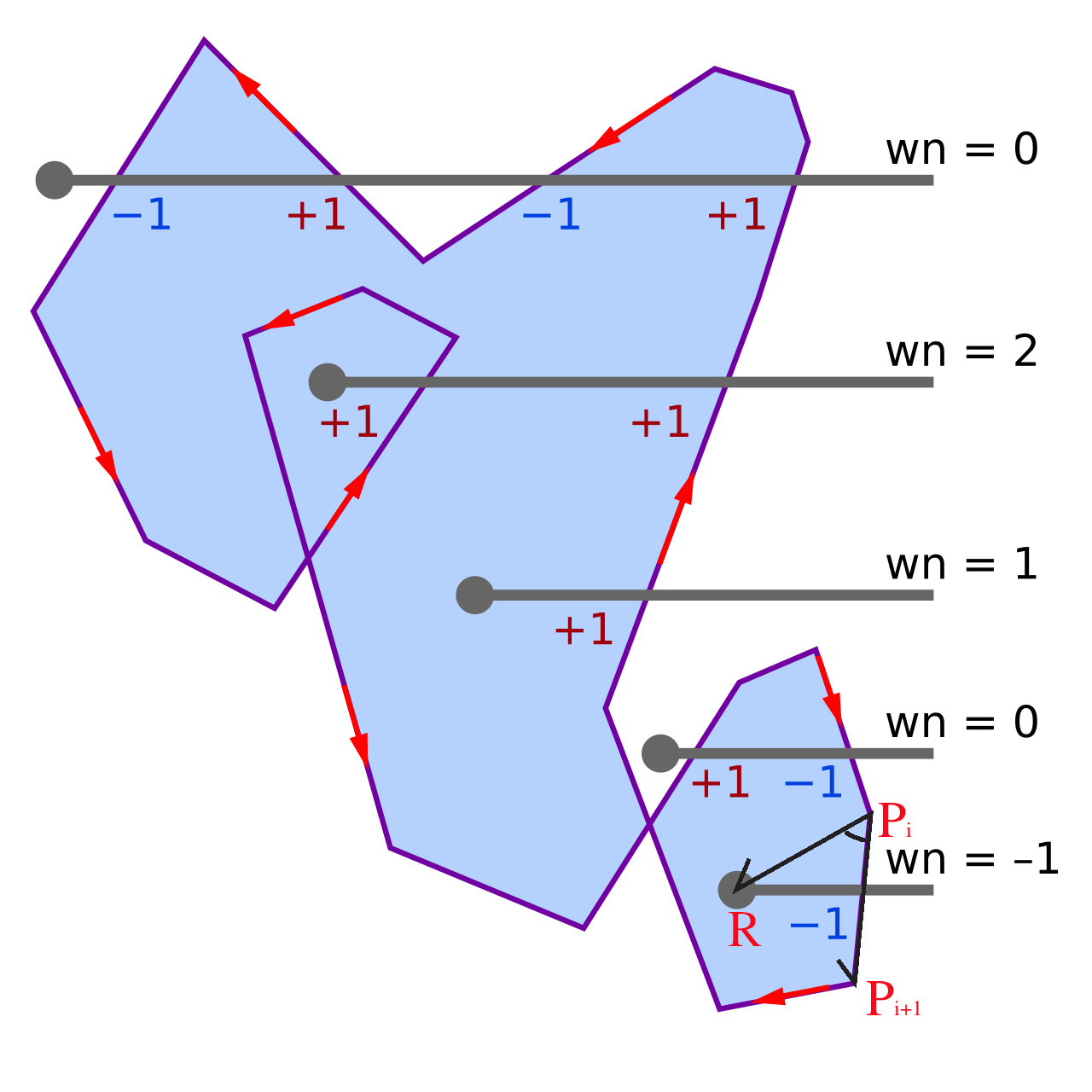

正确思考

Fragment Shader中的循环.Fragment Shader的一切计算都是针对一个片元的, 对于一个片元的计算是不可能影响到另外一个片元的计算.记住这一条之后, 相信对于很多没有接触过

Shader编程的开发人员来说初次接触Fragment Shader的一些迭代会很反直觉:既然只是针对一个片元, 为什么像下面的例子会绘制出 4 条直线而不是 1 条直线呢?

vec2 st = gl_FragCoord.xy / iResolution; float color = 0.0; int iterations = 4; for (int i = 0; i < iterations; i++, st *= 2.0) { // st.x + st.y - 1.0 <= 0.01 相当于函数 y = x color += float(abs(st.x + st.y - 1.0) <= 0.01); // float(true) => 1, float(false) => 0 } gl_FragColor = vec4(vec3(color), 1.0);

Figure 9: 输出结果

观察代码可知每个片元的 \(color\) 要执行 4 轮计算, 每轮计算都 试图 让 \(color\) 自增(我们这里约定能加到 1 才是成功自增),

并且让 \(st\) 翻倍. 我们知道这是在绘制直线 \(y = x\), 但为什么会绘制出 4 条直线呢?

绘制过程 是这样的:

这里选第一长的直线 \(l_{A}\) 和第二长的直线 \(l_{B}\) 作为例子进行分析, 它们是同时绘制的,

这里其实没办法确认它们是否严格意义上的同时绘制, 但至少可以确认在执行顺序上两者不会相互影响.

在 \(l_{A}\) 上的片元 \(p_{A}: (x_{0}, y_{0})\) 在整个迭代中的第 1 轮时, \(abs(st.x + st.y - 1.0) \le 0.01\) 就成立了,

这个时候 \(color\) 自增 1, 之后的 3 轮都是不满足条件因此自增 0;

在 \(l_{B}\) 上的片元 \(p_{B}: (x_{1}, y_{1})\) 只有 在第 2 轮完成

uv缩放: \((x_0, y_0) = 2.0 * (x_1, y_1)\) 后才满足条件使得 \(color\) 自增 1;第三长的直线和最短的直线也是这个道理, 它们符合条件的轮次分别是第 3 和第 4 轮.

这个其实就是一个很简单的绘制递归图案的例子, 我之所以选它是想对新人(我)说明一个事实:

在

Fragment Shader中, 有时候 迭代的每一轮计算更像是一次条件筛选, 整个迭代就是反复试验(trial and error).这算是

Fragment Shader编程中比较常见的迭代用法了, 比起类似以累加/累积为目的的迭代用法特殊一点,它的特殊点在于 为不同颜色赋予了不同的含义: 白色为"有意义计算", 黑色为"无意义计算", 这就是如何为片元赋予颜色.

第 3 步需要运用大量的数学知识, 学习数学知识(主要是微积分)就是为了强化这一步: 根据自己的意愿定义出函数 \(f\).

只有在掌握整个模式后, "不断阅读其他人的代码并从中吸收所涉及的数学概念以及应用方法" 才是有用的.

函数 - mix

这个函数可能换个名字比较好理解一点: \(lerp\), 全称 linear interpolation.

没错, 这个函数就是计算出线性插值的.

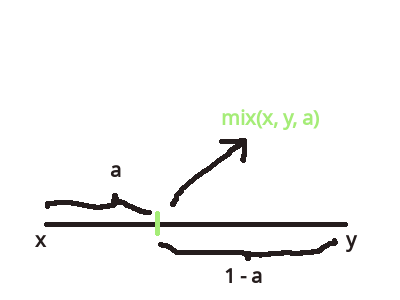

函数定义为 \(mix(x, y, a) = x \times (1 - a) + y \times a\).

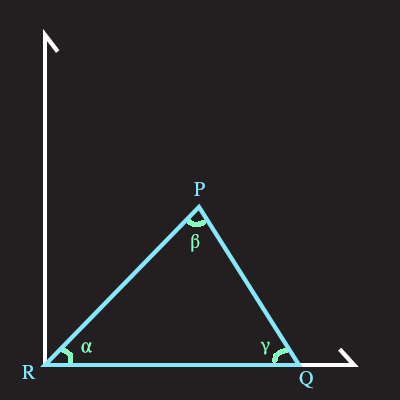

Figure 10: \(mix(x, y, a)\)

这个函数的定义是这么来的,

从 \(x\) 到 \(y\) 的 变化率是固定的 (也就是线性的), 并且整个变化间隔只占了 1 个单位, 因此变化率是 \(k = \frac{y - x}{1}\).

现在想知道处于这个变化过程中的某一刻 \(a\) (\(0 <= a <= 1\)) 时候的值是多少:

\(x + k \times a = x + a \times (y - x) = x + a \times y - a \times x = x \times (1 - a) + y \times a\).

看到这图你可能会联想到前面同样有插值行为的函数 \(smoothstep(edge0, edge1, x)\).

它们之间有三点不同:

- \(mix\) 是线性插值; \(smoothstep\) 是埃尔米特(Hermite)插值, 属于非线性插值.

- \(smoothstep(edge0, edge1, x)\) 的 \(edge0\) 和 \(edge1\) 要保证 \(edge0 \lt edge1\) 的关系(, 甚至要求 \(x\) 位于两者之间, 否则无法按预期插值). \(mix(x, y, a)\) 中的 \(x\) 和 \(y\) 没有这个要求, 可以 \(x \gt y\) 也可以 \(x \lt y\), 甚至可以 \(x = y\), \(a\) 也没有大小限制.

- \(smoothstep(edge0, edge1, x)\) 要求 \(x \in [edge0, edge1]\); \(mix(x, y, a)\) 则没有这个要求, 当 \(a \in [x, y]\) 时叫做内插(

interpolation), 当 \(a\) 位于 \([x, y]\) 之外时叫做外插/外推(extrapolation). 因此, \(smoothstep(edge0, edge1, x) \in [0, 1]\), 而 \(mix(x, y, a) \in \mathbb{R}\).

如你所见, 在 \(mix(2, 4, x)\) 的图像中, \(x = 0\) 时 \(y = 2\), \(x = 1\) 时 \(y = 4\),

\(mix(l, r, a)\) 的函数图像必定符合这个规律: \(x = 0\) 时 \(y = l\), \(x = 1\) 时 \(y = r\).

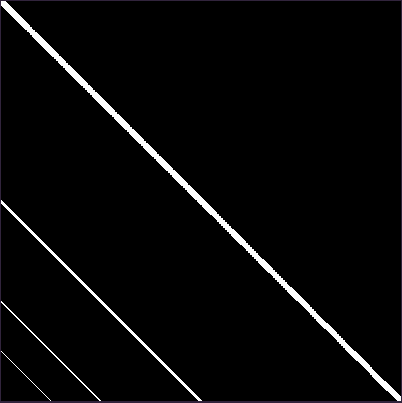

函数 - dFdx/dFdy

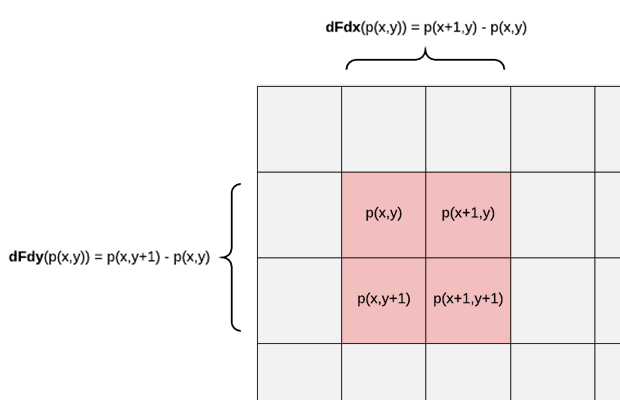

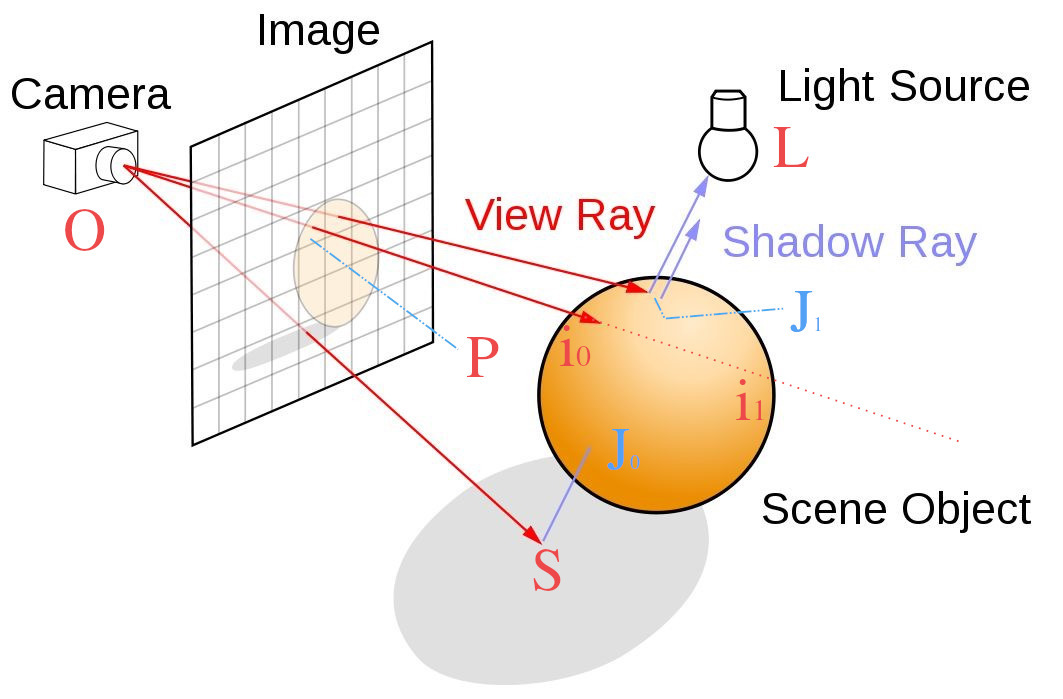

只有 Fragment Shader 支持这两函数, 要想理解它们的作用,

得先知道 GPU 每次都是以 \(2 \times 2\) 这样规模的片元方块作为单位进行处理的, 也就是每次同时调用 4 个 Fragment Shaders,

因此, 在一个 Fragment Shader 中, 对于 GPU 来说可以获取当前片元所在方块内的相邻片元的情况.

我们假设有一个函数 \(p(x, y)\) 可以获取位于 \((x, y)\) 的片元的(在光栅化过程计算得到的)某个属性 \(attr\): \(attr = p(x, y)\),

那么当前片元在 \(x\) 轴方向上的下一个相邻片元的属性值则是为 \(attr_{x+1} = p(x + 1, y)\),

而在 \(y\) 轴方向上的下一个相邻片元的属性值则是为 \(attr_{y+1} = p(x, y + 1)\).

\(dFdx(attr)\) 其实就是在求在当前片元的 \(x\) 轴方向上的某个属性的 \(attr\) 的微分(differentation).

不过在片元这个上下文中, 它非常接近偏导数(partial derivative)的定义:

\(dFdx(attr) = p(x + 1, y) - p(x, y) = \frac{p(x + 1, y) - p(x, y)}{(x + 1) - x} = attr_{x+1} - attr\).

因此可以使用 \(dFdx(attr)\) 求 \(x\) 轴方向的导数近似.

\(dFdy(attr)\) 同理, 其定义如下:

\(dFdy(attr) = p(x, y + 1) - p(x, y) = \frac{p(x, y + 1) - p(x, y)}{(y + 1) - y} = attr_{y+1} - attr\).

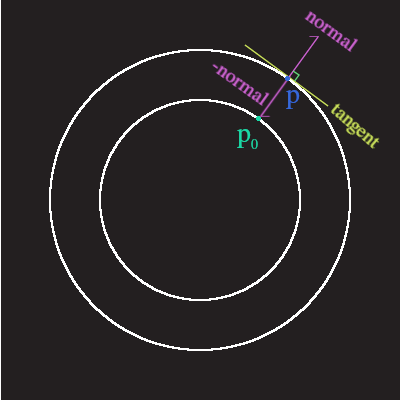

Figure 11: dFdx/dFdy

在 Shader 编程中, 近似导数是求出片元法线的常用手段.

比如下面这个例子在 Fragment Shader 中使用 \(dFdx\) 和 \(dFdy\) 根据片元的视点空间(view space)坐标计算出面法线.

/* vertex shader */ #ifdef GL_ES precision mediump float; #endif uniform mat4 projectionMatrix; uniform mat4 modelViewMatrix; in vec3 position; out vec3 normalInterp; out vec3 pos; void main(){ gl_Position = projectionMatrix * modelViewMatrix * vec4(position, 1.0); vec4 pos4 = modelViewMatrix * vec4(position, 1.0); normalInterp = normalMatrix * normal; pos = vec3(pos4) / pos4.w; }

/* fragment shader */ #ifdef GL_ES precision mediump float; #endif in vec3 pos; in vec3 normalInterp; out vec4 outColor; uniform float bFlat; const vec3 lightPos = vec3(200, 60, 100); const vec3 ambientColor = vec3(0.2, 0.0, 0.0); const vec3 diffuseColor = vec3(0.5, 0.0, 0.0); void main() { vec3 normal = mix(normalize(normalInterp), normalize(cross(dFdx(pos), dFdy(pos))), /* 使用 dFdx 和 dFdy 求出片元所在平面的面法线 */ bFlat); vec3 lightDir = normalize(lightPos - pos); float lambertian = max(dot(lightDir, normal), 0.0); float specular = 0.0; if (lambertian > 0.0) { vec3 viewDir = normalize(-pos); vec3 halfDir = normalize(lightDir + viewDir); float specAngle = max(dot(halfDir, normal), 0.0); specular = pow(specAngle, 16.0); } outColor = vec4(ambientColor + lambertian * diffuseColor + specular * specColor, 1.0); }

函数 - fract

对这个函数进行笔记是因为本人在上面碰过壁, 对于

GLSL里面的每个函数请一定要看它的定义, 并且使用绘图工具绘制一遍.

fract 的官方定义是:

/* 定义 fract 函数 */ fract(x) := x - floor(x)$ /* 绘图 */ plot2d(fract(x), [x, -2, 2]);

我一开始不理解 \(x \to 0\) 时 \(fract(x)\) 附近会是 1, 是因为无视了 \(floor(x)\) 函数的定义: 返回小于或等于 \(x\) 的最接近的整数.

在 \(x \ge 0\) 时, \(floor(x)\) 和 \(trunc(x)\) 的作用是一样的: 直接返回整数部分.

但是根据定义, 对于 \(x \lt 0\) 的时候就不一样了, 比如 \(floor(-0.01) = -1\), 而不是返回 0, 因此 \(fract(-0.01) = -0.01 + 1 = 0.99\).

既然提到了 \(floor\) 函数, 我觉得还是有必要提一下 \(ceil\) 函数以及 \(round\) 函数.

它们三者的作用都是处理掉浮点数的小数部分, 但是处理方式是完全不一样的, 在特殊情况下导致的结果也是天差地别.

如果不是经常使用, 很容易会因为对它们的定义不熟悉而写出意料之外的

shader code, 又由于对它们的不熟悉导, 在找出问题时也很难怀疑到它们身上.所以不要掉以轻心, 我写这个函数就是因为痛苦的经历.

\(ceil(x)\) 函数定义就和 \(floor(x)\) 的完全相反: 返回大于或等于 \(x\) 的最接近整数. \(ceil(x)\) 的作用看上去和 \(trunc(x)\) 差很远, 所以就不过多解释.

\(round(x)\) 就是"四舍五入", 当 \(x\) 的小数部分大于或等于 \(0.5\) 就进 \(1\), 相信很多人都是在小学一/二年纪了解到这个概念, 但是那个时候是没有学负数的(, 学了负数后面好像也没有回顾"四舍五入"这个概念),

这个进 \(1\) 是否就像正数那样给 \(x\) 的整数部分加 \(1\) 呢? 刚好相反, 对于负数而言进 \(1\) 是减 \(1\), 所以 \(round(-1.5) = -2\), 而不是 \(0\).

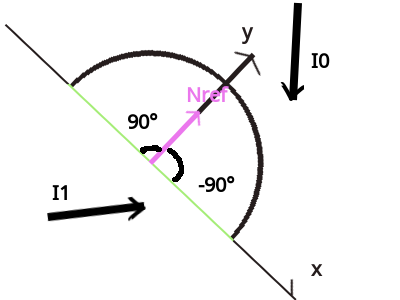

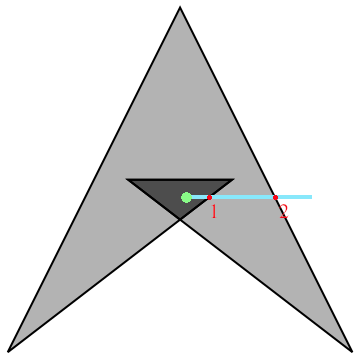

函数 - faceforward

\(faceforward(N, I, Nref)\) 函数用于判断入射向量 \(I(ncident vector)\) 和表面法线向量 \(Nref\) 是否一致朝向(指向同一个半球(hemisphere)/半圆(semicircle)的方向),

如果不是, 就要把法线向量 \(N\) 反转(\(-1 \times N\))并把它作为结果返回, 否则直接返回 \(N\).

通常 \(Nref\) 的值是和 \(N\) 是一样的,

所以这个函数一般是用来判断表面的面向是否为正面, 不是的话就进行纠正, 这就是函数名字的由来.

函数的定义:

如果 \(dot(I, Nref) < 0\), 表明 \(I\) 是从表面的正面进入, 返回 \(N\);

如果 \(dot(I, Nref) > 0\), 表明 \(I\) 是从表面的背面进入, 返回 \(-1 \times N\).

/* 定义 faceforward 函数 */ faceforward(n, i, nr) := block( return (-1 * signum(i . nr) * n) )$ /* Test */ /* faceforward([0, 1], [-4, 2], [0, 1]); */ /* faceforward([1, 0], [-4, -2], [1, 0]); */

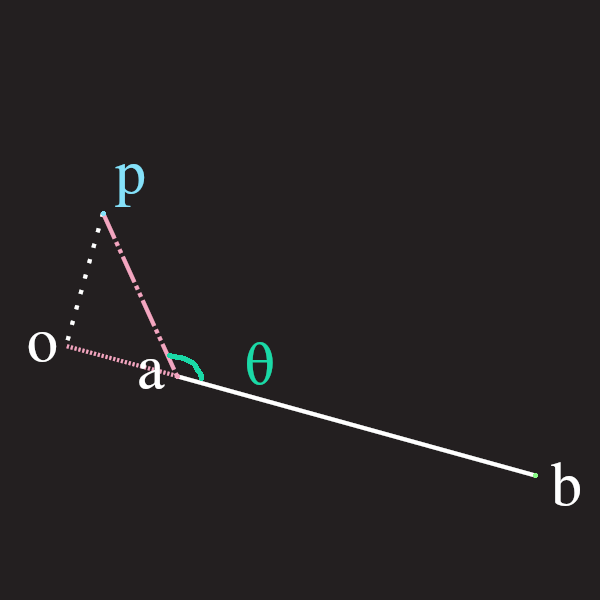

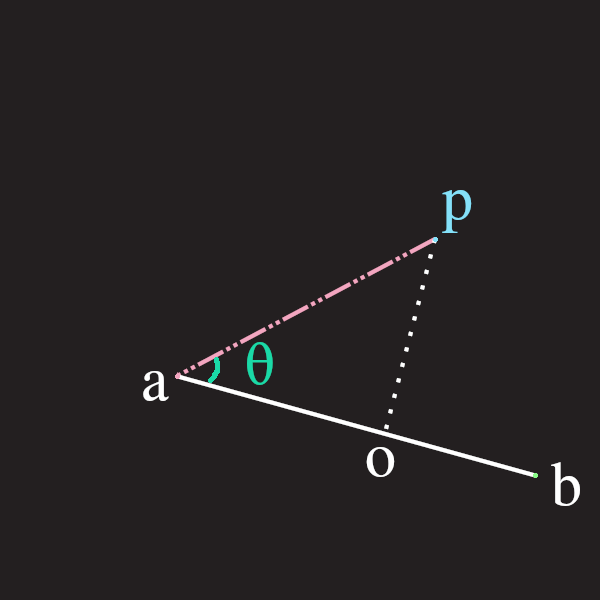

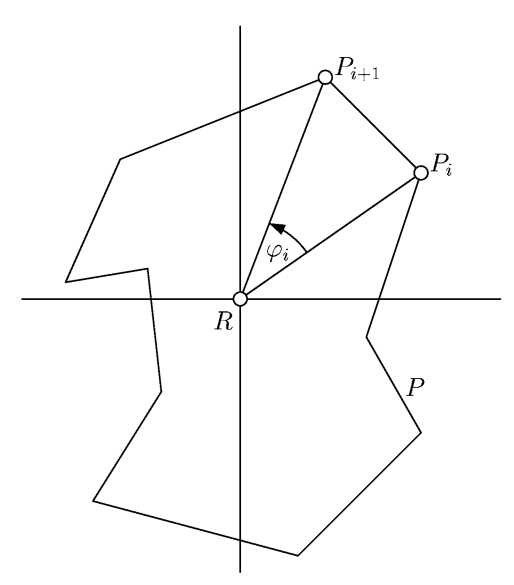

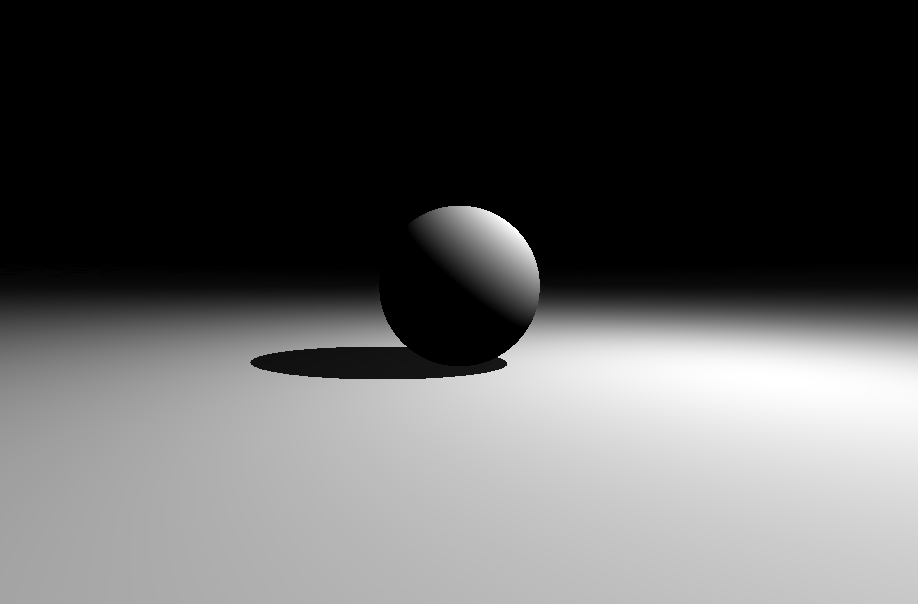

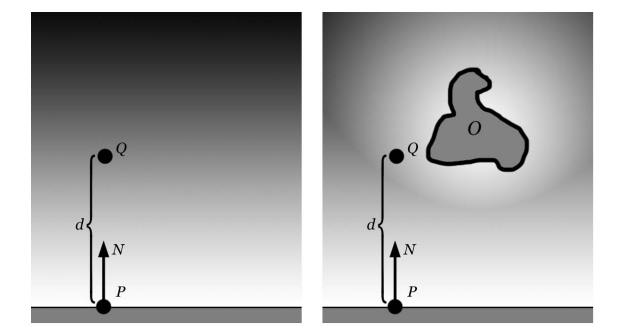

Figure 12: faceforward

如果不理解的话可以看这图,

\(dot(I, Nref) = |I||Nref|\cos(angle(I, Nref))\), 其中 \(angle(I, Nref)\) 是向量 \(I\) 和 向量 \(Nref\) 之间的角度.

根据 \(\cos\) 函数图像可以知道, 如果 \(\frac{-\pi}{2} < angle(I, Nref) < \frac{\pi}{2}\), 那么 \(dot(I, Nref) > 0\),

很明显, 图中的 \(I1\) 符合这种情况: \(dot(I1, Nref) > 0\);

如果 \(\frac{-\pi}{2} > angle(I, Nref)\) 或 \(\frac{\pi}{2} < angle(I, Nref)\), 那么 \(dot(I, Nref) < 0\).

没错, \(I0\) 符合这种情况(, 准确一点是满足 \(\frac{-\pi}{2} > angle(I0, Nref)\)), 因此 \(dot(I0, Nref) < 0\).

如果还不理解的话, 可以看一下这个地址: mathematically-what-does-faceforward-fhunction-mean.

函数 - reflect

\(reflect(I, N)\) 函数用于计算 \(I\) 射入面向 \(N\)(需要确保被一般化) 的表面后的反射方向: \(I - 2.0 \times dot(N, I) \times N\).

这个函数定义的推导过程可以看我以前的文章, 这里不再赘述.

\(I\) 是从光源位置到照射点的方向.

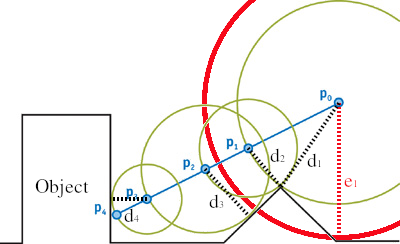

函数 - refract

\(refract(I, N, eta)\) 函数用于计算出入射光线 \(I\) 经过面向 \(N\) 表面(surface)后的折射光线的向量, \(eta\) 是表面的折射率比(ratio of indices of refraction).

\(I\) 是从光源位置到照射点的方向.

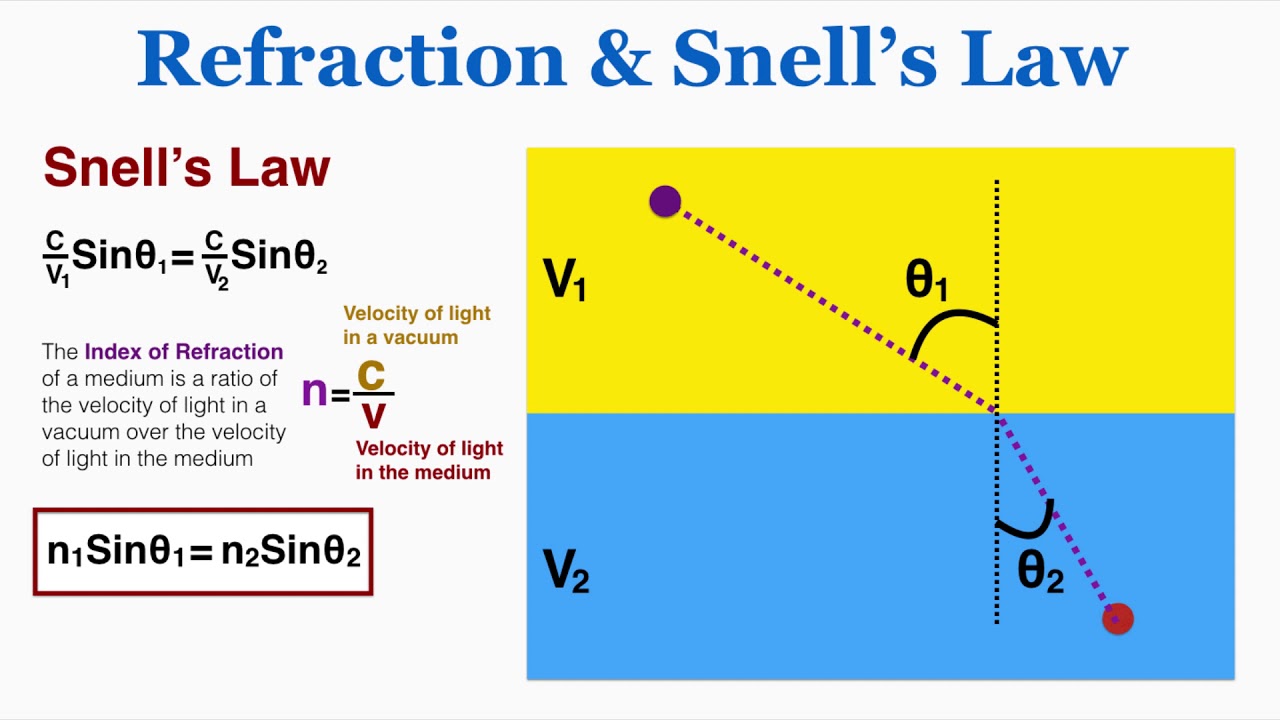

想了解 \(eta\) 的定义, 得先了解斯涅尔定律(Snell's law), 又叫折射定律.

折射的产生是光在不同介质的传播速度不一致导致的, 比如光在空气的传播速度大于光在水中的传播速度.

介质的折射率(refractive index)是对光在介质中传播速度的度量, 折射率越大, 光的传播速度越小.

Figure 13: 折射 & 斯涅尔定律(图来自 IB Physics)

根据定律, \(n_1\) 和 \(n_2\) 分别是两种介质的折射率, 那么 \(eta = \frac{n_{1}}{n_{2}} = \frac{\sin\theta_{2}}{\sin\theta_{1}}\) 或者 \(eta = \frac{n_{2}}{n_{1}} = \frac{\sin\theta_{1}}{\sin\theta_{2}}\)? 究竟是哪个呢?

\(refract\) 的文档并没有说明这一切, 于是我在 StackOverflow 上通过这一篇帖子找到了答案: glsl refract function explanation available.

我还在这篇帖子上收获了另外一个技巧: 在 Google Books 里面检索一些较为专业的名词/概念, 比如 "refraction vector".

事实上很多这种专业的名词/概念很少会出现在搜索引擎上的, 通常只会出现在教材上, 所以这个技巧对自学者很重要.

这篇帖子直接给出了折射向量的公式推导, 不过还是得写下自己的理解(, 因为要看懂它的推导还需要一些额外的概念补充, 以及添加额外说明使它更易懂).

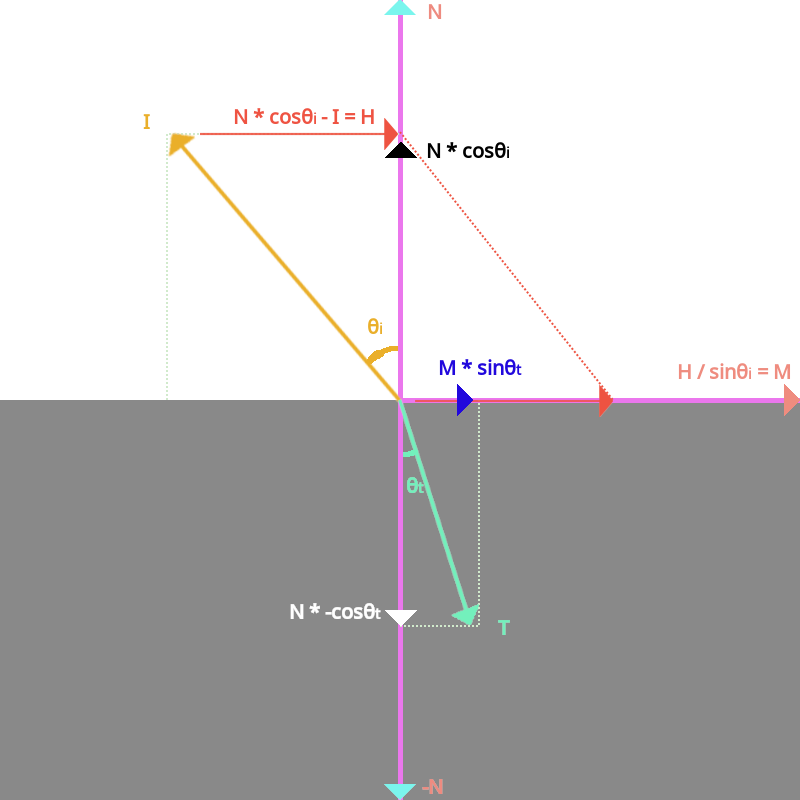

Figure 14: 折射向量推导

根据函数 refract 的定义, \(I\) / \(N\) / \(M\) 都是单位向量, 这也是上图向量关系能成立的重要原因.

但需要注意图中的 \(I\) 与 \(refract\) 中的 \(I\) 是相反方向

\(M\) 是垂直于 \(N\) 的向量, 而向量 \(T\) 是 \(refract(I, N, eta)\) 的返回结果: 折射向量.

从图中可以看出, 求出 \(T\) 的关键是求出向量 \(M\). 而向量 \(H\) 的单位向量就是 \(M\),

\(H\) 和 \(M\) 的模长大小关系为: \(\sin\theta_{i} = \frac{|H|}{|I|} = \frac{|H|}{|M|} = |H|\),

因此, \(M = \frac{H}{\sin\theta_{i}}\).

现在可以计算出:

\(\begin{equation*} \begin{aligned} T &= M \times \sin\theta_{t} - N \times \cos\theta_{t} \\ &= \frac{\sin\theta_{t}}{\sin\theta_{i}}(N \times \cos\theta_{i} - I) - N \times \cos\theta_{t} \\ &= \frac{\sin\theta_{t}}{\sin\theta_{i}} \times N \times \cos\theta_{i} - \frac{\sin\theta_{t}}{\sin\theta_{i}} \times I - N \times \cos\theta_{t} \\ &= (\frac{\sin\theta_{t}}{\sin\theta_{i}} \times \cos\theta_{i} - \cos\theta_{t}) \times N - \frac{\sin\theta_{t}}{\sin\theta_{i}} \times I \end{aligned} \end{equation*}\)

现在回过头来看 \(eta\), 从计算 \(T\) 的方程中, 选择 \(eta = \frac{\sin\theta_{t}}{\sin\theta_{i}}\) 比较合适, 所以 \(T = (eta \times \cos\theta_{i} - \cos\theta_{t}) \times N - eta \times I\).

已经没办法从上面的图获得任何有用的线索了, 换个思路: 从答案出发找出线索来连接目前得到的结论.

回头看一下 \(refract(I, N, eta)\) 的定义:

k = 1.0 - eta * eta * (1.0 - dot(N, I) * dot(N, I)); if (k < 0.0) R = genType(0.0); // or genDType(0.0) else R = eta * I - (eta * dot(N, I) + sqrt(k)) * N;

初看代码可能不知道 \(k\) 的含义是什么, 但只要把 \(eta\) 带入进去就明白了:

\(\begin{equation*}\begin{aligned} k &= 1.0 - eta \times eta \times (1.0 - dot(N, I) \times dot(N, I)) \\ &= 1.0 - \frac{\sin^{2}\theta_{t}}{\sin^{2}\theta_{i}} \times (1.0 - \cos^{2}\theta_{i}) \\ &= 1.0 - \frac{\sin^{2}\theta_{t}}{\sin^{2}\theta_{i}} \times \sin^{2}\theta_{i} \\ &= \cos^{2}\theta_{t} \end{aligned} \end{equation*}\)

现在整个 \(refract\) 的定义及其背后的含义已经全部解析完毕.

但你会发现 \(refract\) 函数定义与 \(T\) 是不一致的, 因为 \(refract\) 的 \(I\) 是从光源位置到照射点的方向, 与图片相反,

接下来以 \(refract\) 的 \(I\) 进行简单推导:

令 \(I\) 为 \(refract\) 函数定义的 \(I\), 得出上述向量 \(\begin{cases} H = I + N \times \cos\theta_i \\ M = \frac{H}{\sin\theta_i} \end{cases}\),

\(\begin{equation*} \begin{aligned} T = & \frac{I + N \times \cos\theta_i}{\sin\theta_i} \times \sin\theta_t - N \times \cos\theta_t \\ = & \frac{\sin\theta_t}{\sin\theta_i} (I + N \times \cos\theta_i) - N \times \cos\theta_t \\ = & \frac{\sin\theta_t}{\sin\theta_i} \times I + \frac{\sin\theta_t}{\sin\theta_i} \times N \times \cos\theta_i - N \times \cos\theta_t \\ = & \frac{\sin\theta_t}{\sin\theta_i} \times I + (\frac{\sin\theta_t}{\sin\theta_i} \times \cos\theta_i - \cos\theta_t) \times N \\ = & eta \times I + (eta \times \cos\theta_i - \cos\theta_t) \times N \end{aligned} \end{equation*}\)

其中根据几何关系可得出 \(\cos\theta_i = dot(-N, I) = - dot(N, I)\), 所以:

\(\begin{equation*}\begin{aligned} T = & eta \times I + (-eta \times dot(N, I) - \cos\theta_t ) \times N \\ = & eta \times I - (eta \times dot(N, I) + \cos\theta_t ) \times N \end{aligned}\end{equation*}\)

\(k\) 的值不受 \(I\) 的方向影响, 最终的推导结果与 \(refract\) 的定义一致.

在开发中通常会模拟现实中的一些折射情况, 幸好有人整理了各种材质的折射率(index of refraction).

比如说想计算从空气射入水中的折射情况, 空气的折射率是 \(1\), \(0\) 摄氏度的水折射率是 \(1.333\), 那么此时 \(eta = \frac{1}{1.333}\).

函数 - packUnorm 和 函数 - unpackUnorm

这两个函数只是用来把数据打包和解包.

举个例子, 我们知道 Fragment Shader 里面的片元颜色是这么个结构: \((r, g, b, a)\), 每个分量的范围都是 \([0.0, 1.0]\).

但是在一些程序中的颜色结构中, 分量的范围就变成 \([0, 255]\), 比如浏览器中的 #F2F1F0, 这个其实就是 \(242 \times 16^{4} + 241 \times 16^{2} + 240 \times 16^{0}\) 的 16 进制表示.

要完成从 \([0.0, 1.0]\) 到 \([0, 255]\) 的转换很简单, 针对分量进行这样的操作: \(round(x * 255.0)\).

然而, 这样的话会很繁琐, 毕竟 GLSL 支持 vec4, 对一个 vec4 进行转换就得手写 4 条这样的操作,

因此, GLSL 提供了 \(packUnorm\) 一套函数来减轻开发人员的负担, 另外还提供了 \(unpackUnorm\) 一套函数来完成 "从 \([0, 255]\) 到 \([0.0, 1.0]\)" 这样的逆操作.

这里就不再对函数的定义进行详细说明了, 写这个小节是因为初见该函数没了解到它是做什么的而已, 实际了解下来还是挺简单的.

函数 - modf

\(modf(x, out\ i)\) 把浮点数 \(x\) 分开整数和小数两部分, 整数部分(integer part)会储存在参数 \(i\) 中, 小数部分(fractional part)则是作为函数的返回值.

不要和 \(mod\) 函数搞混.

float f; float i; f = modf(1.2, i); /* i = 1.0, f = 0.2 */ vec2 fs; vec2 is; fs = modf(vec2(1.2, -3.4), is); /* fs = vec2(0.2, -0.4), is = ivec2(1.0, -3.0) */

函数 - texture

\(texture\) 函数从贴图 \(tex\) 中获取指定纹理坐标 \(texCoord\) 上的纹素(texels), 一般用法是 \(texture(tex, texCoord)\).

贴图分

1D,2D和3D贴图, 这里主要介绍2D贴图.在

OpenGL中 \(texture\) 函数支持从三种贴图种获取纹素, 这里实际上介绍的是OpenGL ES中的 \(texture2D\) 函数.

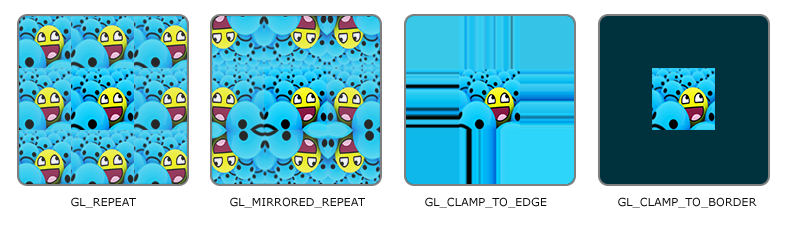

现在有一个问题: 如果 \(texCoord\) 的分量超出 \([0.0, 1.0]\) 的范围怎么办? 这就涉及贴图的一个属性 - 纹理环绕 (texture wrapping).

纹理环绕是指纹理坐标 \(texCoord\) 的分量超出范围 \([0.0, 1.0]\) 时该如何处理这些超出的坐标, OpenGL 里面有 4 种选项给开发者进行选择:

GL_REPEAT: 默认模式, 使得贴图重复, 调用时效果如下:uniform sampler2D tex; uniform vec2 texCoord; // vec4 texel = texture(tex, texCoord); 等同以下 vec4 texel = texture(tex, fract(texCoord));

GL_MIRRORED_REPEAT: 类似GL_REPEAT, 只不过是镜像重复, 调用时效果如下:uniform sampler2D tex; uniform vec2 texCoord; // vec4 texel = texture(tex, texCoord); 等同以下 vec2 is; vec2 fs = modf(texCoord, is); float texCoordS = mod(is.x, 2) == 0 ? fs.s : 1 - fs.s; float texCoordT = mod(is.y, 2) == 0 ? fs.t : 1 - fs.t; vec4 texel = texture(tex, vec2(texCoordS, texCoordT));

也就是

texCoord分量的整数 \(i\) 部分为偶数时, 分量就被会被它自己的小数部分 \(f\) 取代; 如果分量的整数部分 \(i\) 为奇数, 分量就会被 \(1 - f\) 取代.GL_CLAMP_TO_EDGE: 把贴图坐标的分量限定在 \([0.0, 1.0]\) 的范围内, 调用效果如下:uniform sampler2D tex; uniform vec2 texCoord; // vec4 texel = texture(tex, texCoord); 等同以下 vec4 texel = texture(tex, clamp(texCoord, 0.0, 1.0));

GL_CLAMP_TO_BORDER: 类似GL_CLAMP_TO_EDGE, 但当根据超出范围的贴图坐标获取纹素时, 该纹素的颜色为用户指定颜色,这个颜色要通过

OpenGL的API去设置GL_TEXTURE_BORDER_COLOR这个贴图属性的值来进行指定, 调用效果如下:uniform sampler2D tex; uniform vec2 texCoord; uniform vec4 borderColor; // 用户指定的颜色 // vec4 texel = texture(tex, texCoord); 等同以下 vec4 texel = (texCoord.s > 1 || texCoord.s < 0 || texCoord.t > 1 || texCoord.t < 0) ? borderColor : texture(tex, clamp(texCoord, 0.0, 1.0));

Figure 15: 贴图环绕的 4 种选择 (图片来自 LearnOpenGL)

在 ShaderToy 的程序开发中, 很少会用到立方体贴图, 立方体贴图就是所谓的 3D 贴图, 游戏开发中会经常用到.

我的另外一篇笔记有介绍立方体贴图的采样, 以及如何使用 2D 贴图替代立方体贴图,

后者是在 ShaderToy 程序上使用立方体贴图的方案.

常用自定义函数或宏

以下这些函数大部分是在其它图形库或 Blender 这样的建模软件移植过来.

remap 函数

\(remap(value, low1, high1, low2, high2)\): 对 \(value\) 从 \([low1, high1]\) 映射到 \([low2, high2]\) 上, 并返回经过重新映射后的 \(value\).

因此, 函数的定义是: \(low2 + \frac{value - low1}{high1 - low1} \times (high2 - low2)\).

float remap(float value, float low1, float high1, float low2, float high2) { return low2 + (value - low1) / (high1 - low1) * (high2 - low2); } vec2 remap(vec2 value, vec2 low1, vec2 high1, vec2 low2, vec2 high2) { return low2 + (value - low1) / (high1 - low1) * (high2 - low2); } vec3 remap(vec3 value, vec3 low1, vec3 high1, vec3 low2, vec3 high2) { return low2 + (value - low1) / (high1 - low1) * (high2 - low2); } vec4 remap(vec4 value, vec4 low1, vec4 high1, vec4 low2, vec4 high2) { return low2 + (value - low1) / (high1 - low1) * (high2 - low2); }

ColorRamp 宏

该宏的设计参考 Blender 的 Color Ramp Node.

#define COLOR_RAMP(inputColors, inputPosition, finalColor) { \ const int len = inputColors.length(); \ int index = 0; \ for (int i = 0; i < len - 1; i++) { \ Color currentColor = inputColors[i]; \ Color nextColor = inputColors[i + 1]; \ bool pointExists = currentColor.position <= inputPosition && inputPosition <= nextColor.position; \ index = pointExists ? i : index; \ } \ Color currentColor = inputColors[index]; \ Color nextColor = inputColors[index + 1]; \ vec3 c1 = currentColor.c; \ vec3 c2 = nextColor.c; \ float range = nextColor.position - currentColor.position; \ float lerpFactor = (inputPosition - currentColor.position) / range; \ finalColor = mix(c1, c2, lerpFactor); \ } \ // 用法 struct Color { vec3 c; float position; }; void main() { vec3 color; Color[4] colors = Color[]( Color(vec3(1.), 0.0), Color(vec3(0.8), 0.01), Color(vec3(0.2, 0.5, 0.2), 0.1), Color(vec3(0.01, 0.05, 0.2), 1.0)); float position = 0.3; COLOR_RAMP(colors, position, color); gl_FragColor = vec4(color, 1.); }

luma 函数

计算像素的亮度(luminance), 公式来源于 Rec.709: \(0.2126 \times R + 0.7152 \times G + 0.0722 \times B\).

float luma(vec3 rgb) { return dot(vec3(0.2126, 0.7152, 0.0722), rgb); }

缓动函数

缓动函数(Easing Function) 是插值函数的一种, 比如 \(f\) 用于描述变量 \(p\) 如何随着时间 \(t\) 的变化而变化.

在数学上, 其定义大概为: \(p = f(t)\), 其中 \(t \in [0, 1]\), \(t\) 是一个规范化的时间,

\(p\) 它没有固定范围, 但满足关系: \(p = \begin{cases} 0 & \text{if } t = 0 \\ 1 & \text{if } t = 1 \end{cases}\).

另外, \(t\) 和 \(p\) 的关系类似与时间和位移之间关系, 一阶导数 \(f^{'}(t)\) 就是动画的当前播放速度, 二阶导数 \(f^{''}(t)\) 是动画的当前播放加速度.

缓动函数的作用通常是让运动的速度看起来更加自然, 而不是机械的匀速运动,

比如说汽车在启动到驾驶到目的地, 整个过程至少经历了缓缓加速(Ease-in)和缓缓减速(Ease-out)两个过程,

而不是一开始就以固定速度启动, 然后在目的地直接变为 0 速.

还有缓出缓入(Ease-In-Out), 这一类函数整体上是先从静止状态逐渐加速, 在中间阶段达到最大速度, 然后逐渐减速直到静止.

以下代码的实现参考至 https://easings.net/.

#define PI 3.14159265359 #define POW_IN(n, t) (pow(t, n)) #define POW_OUT(n, t) (pow(1.0 - (t), n)) #define POW_IN_OUT(n, t) ((t) < 0.5 ? pow(2.0, (n) - 1.0) * pow(t, n): 1.0 - 0.5 * pow(-2.0 * t + 2.0, n)) float easeInSine(float t) { return 1.0 - cos(0.5 * PI * t); } float easeOutSine(float t) { return sin(0.5 * PI * t); } float easeInOutSine(float t) { return -0.5 * (cos(PI * t) - 1.0); } // Pow 2 float easeInQuad(float t) { return POW_IN(2.0, t); } float easeOutQuad(float t) { return POW_OUT(2.0, t); } float easeInOutQuad(float t) { return POW_IN_OUT(2.0, t); } // Pow 3 float easeInCubic(float t) { return POW_IN(3.0, t); } float easeOutCubic(float t) { return POW_OUT(3.0, t); } float easeInOutCubic(float t) { return POW_IN_OUT(3.0, t); } // Pow 4 float easeInQuart(float t) { return POW_IN(4.0, t); } float easeOutQuart(float t) { return POW_OUT(4.0, t); } float easeInOutQuart(float t) { return POW_IN_OUT(4.0, t); } // Pow 5 float easeInQuint(float t) { return POW_IN(5.0, t); } float easeOutQuint(float t) { return POW_OUT(5.0, t); } float easeInOutQuint(float t) { return POW_IN_OUT(5.0, t); } // Expo float easeInExpo(float t) { return t == 0.0 ? 0.0: pow(2.0, 10.0 * t - 10.0); } float easeOutExpo(float t) { return t == 1.0 ? 1.0: 1.0 - pow(2.0, -10.0 * t); } float easeInOutExpo(float t) { if (0.0 == x || 1.0 == x) { return x; } else if (x < 0.5) { return 0.5 * pow(2.0, 20.0 * t - 10.0); } else { return 0.5 * (2.0 - pow(2.0, -20.0 * t + 10.0)); } } // Circ float easeInCirc(float t) { return 1.0 - sqrt(1.0 - pow(x, 2.0)); } float easeOutCirc(float t) { return sqrt(1.0 - pow(x - 1.0, 2.0)); } float easeInOutCirc(float t) { return x < 0.5 ? 0.5 * (1.0 - sqrt(1.0 - pow(2.0 * x, 2.0))): 0.5 * (sqrt(1.0 - pow(-2.0 * x + 2.0, 2.0)) + 1.0); } // Back #define OVERSHOT 1.70158 float easeInBack(float t) { // 和 smoothstep 非常相似 return (OVERSHOT + 1.0) * pow(t, 3.0) - OVERSHOT * pow(t, 2.0); } float easeOutBack(float t) { return 1.0 + (OVERSHOT + 1.0) * pow(t - 1.0, 3.0) + OVERSHOT * pow(t - 1.0, 2.0); } float easeInOutBack(float t) { float c2 = OVERSHOT * 1.525; return t < 0.5 ? 0.5 * pow(2.0 * t, 2.0) * ((c2 + 1.0) * 2.0 * t - c2): 0.5 * (pow(2.0 * t - 2.0, 2.0) * ((c2 + 1.0) * (2.0 * t - 2.0) + c2) + 2.0); } // Elastic float easeInElastic(float t) { float c4 = 2.0 * PI / 3.0; if (0.0 == t || 1.0 == t) { return t; } else { return -pow(2.0, 10.0 * t - 10.0) * sin((10.0 * t - 10.75) * c4); } } float easeOutElastic(float t) { float c4 = 2.0 * PI / 3.0; if (0.0 == t || 1.0 == t) { return t; } else { return pow(2.0, -10.0 * t) * sin((t * 10.0 - 0.75) * c4) + 1.0; } } float easeInOutElastic(float t) { float c5 = 2.0 * PI / 4.5; if (0.0 == t || 1.0 == t) { return t; } else if (t < 0.5) { return -0.5 * pow(2.0, 20.0 * t - 10.0) * sin((20.0 * t - 11.125) * c5); } else { return 0.5 * pow(2.0, -20.0 * t + 10.0) * sin((20.0 * t - 11.125) * c5) + 1.0; } } // Bounce float easeInBounce(float t) { return 1.0 - easeOutBounce(1.0 - t); } float easeOutBounce(float t) { float n1 = 7.5625; float d1 = 2.75; if (t < 1.0 / d1) { return n1 * t * t; } else if (t < 2.0 / d1) { return n1 * pow(t - 1.5 / d1, 2.0) + 0.75; } else if (t < 2.5 / d1) { return n1 * pow(t - 2.25 / d1, 2.0) + 0.9375; } else { return n1 * pow(t - 2.625 / d1, 2.0) + 0.984375; } } float easeInOutBounce(float t) { return t < 0.5 ? 0.5 * (1.0 - easeOutBounce(1.0 - 2.0 * t)): 0.5 * (1.0 + easeOutBounce(2.0 * t - 1.0)); }

以下是这些缓动函数的 Maxima 实现以及绘制函数本身以及一阶和二阶导数图像的命令:

load("draw")$ /* Sine */ easeInSine(x) := 1 - cos(0.5 * %pi * x)$ plot2d(easeInSine(x), [x, 0, 1])$ plot2d(diff(easeInSine(x), x), [x, 0, 1])$ plot2d(diff(easeInSine(x), x, 2), [x, 0, 1])$ easeOutSine(x) := sin(0.5 * %pi * x)$ plot2d(easeOutSine(x), [x, 0, 1])$ plot2d(diff(easeOutSine(x), x), [x, 0, 1])$ plot2d(diff(easeOutSine(x), x, 2), [x, 0, 1])$ easeInOutSine(x) := -0.5 * (cos(%pi * x) - 1)$ plot2d(easeInOutSine(x), [x, 0, 1])$ plot2d(diff(easeInOutSine(x), x), [x, 0, 1])$ plot2d(diff(easeInOutSine(x), x, 2), [x, 0, 1])$ /* Quad */ easeInQuad(x) := x * x$ plot2d(easeInQuad(x), [x, 0, 1])$ plot2d(diff(easeInQuad(x), x), [x, 0, 1])$ plot2d(diff(easeInQuad(x), x, 2), [x, 0, 1])$ easeOutQuad(x) := 1.0 - (1.0 - x) * (1.0 - x)$ plot2d(easeOutQuad(x), [x, 0, 1])$ plot2d(diff(easeOutQuad(x), x), [x, 0, 1])$ plot2d(diff(easeOutQuad(x), x, 2), [x, 0, 1])$ easeInOutQuad(x) := if x < 0.5 then 2 * x * x else 1 - 0.5 * (-2 * x + 2)^2$ plot2d(easeInOutQuad(x), [x, 0, 1])$ draw2d(color=red, explicit(diff(2 * x^2, x), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^2, x), x, 0.5, 1) )$ draw2d( yrange=[-5, 5], color=red, explicit(diff(2 * x * x, x, 2), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^2, x, 2), x, 0.5, 1) )$ /* Cubic */ easeInCubic(x) := x^3$ plot2d(easeInCubic(x), [x, 0, 1])$ plot2d(diff(easeInCubic(x), x), [x, 0, 1])$ plot2d(diff(easeInCubic(x), x, 2), [x, 0, 1])$ easeOutCubic(x) := 1.0 - (1.0 - x)^3$ plot2d(easeOutCubic(x), [x, 0, 1])$ plot2d(diff(easeOutCubic(x), x), [x, 0, 1])$ plot2d(diff(easeOutCubic(x), x, 2), [x, 0, 1])$ easeInOutCubic(x) := if x < 0.5 then 4 * x^3 else 1 - 0.5 * (-2 * x + 2)^3$ plot2d(easeInOutCubic(x), [x, 0, 1])$ draw2d(color=red, explicit(diff(4 * x^3, x), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^3, x), x, 0.5, 1) )$ draw2d(color=red, explicit(diff(4 * x^3, x, 2), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^3, x, 2), x, 0.5, 1) )$ /* Quart */ easeInQuart(x) := x^4$ plot2d(easeInQuart(x), [x, 0, 1])$ plot2d(diff(easeInQuart(x), x), [x, 0, 1])$ plot2d(diff(easeInQuart(x), x, 2), [x, 0, 1])$ easeOutQuart(x) := 1.0 - (1.0 - x)^4$ plot2d(easeOutQuart(x), [x, 0, 1])$ plot2d(diff(easeOutQuart(x), x), [x, 0, 1])$ plot2d(diff(easeOutQuart(x), x, 2), [x, 0, 1])$ easeInOutQuart(x) := if x < 0.5 then 8 * x^4 else 1 - 0.5 * (-2 * x + 2)^4$ plot2d(easeInOutQuart(x), [x, 0, 1])$ draw2d(color=red, explicit(diff(8 * x^4, x), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^4, x), x, 0.5, 1) )$ draw2d(color=red, explicit(diff(8 * x^4, x, 2), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^4, x, 2), x, 0.5, 1) )$ /* Quint */ easeInQuint(x) := x^5$ plot2d(easeInQuint(x), [x, 0, 1])$ plot2d(diff(easeInQuint(x), x), [x, 0, 1])$ plot2d(diff(easeInQuint(x), x, 2), [x, 0, 1])$ easeOutQuint(x) := 1.0 - (1.0 - x)^5$ plot2d(easeOutQuint(x), [x, 0, 1])$ plot2d(diff(easeOutQuint(x), x), [x, 0, 1])$ plot2d(diff(easeOutQuint(x), x, 2), [x, 0, 1])$ easeInOutQuint(x) := if x < 0.5 then 16 * x^5 else 1 - 0.5 * (-2 * x + 2)^5$ plot2d(easeInOutQuint(x), [x, 0, 1])$ draw2d(color=red, explicit(diff(16 * x^5, x), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^5, x), x, 0.5, 1) )$ draw2d(color=red, explicit(diff(16 * x^5, x, 2), x, 0, 0.5), color=blue, explicit(diff(1 - 0.5 * (-2 * x + 2)^5, x, 2), x, 0.5, 1) )$ /* Expo */ easeInExpo(x) := if x # 0 then 2^(10.0 * x - 10.0) else 0$ plot2d(easeInExpo(x), [x, 0, 1])$ plot2d(diff(easeInExpo(x), x), [x, 0, 1])$ plot2d(diff(easeInExpo(x), x, 2), [x, 0, 1])$ easeOutExpo(x) := if x # 1 then 1 - 2^(-10.0 * x) else 1$ plot2d(easeOutExpo(x), [x, 0, 1])$ plot2d(diff(easeOutExpo(x), x), [x, 0, 1])$ plot2d(diff(easeOutExpo(x), x, 2), [x, 0, 1])$ easeInOutExpo(x) := if (x = 0 or x = 1) then x else if x < 0.5 then 0.5 * 2^(20 * x - 10) else 0.5 * (2 - 2^(-20 * x + 10))$ plot2d(easeInOutExpo(x), [x, 0, 1])$ draw2d(color=red, explicit( diff(0.5 * 2^(20 * x - 10), x), x, 0, 0.5), color=blue, explicit(diff(0.5 * (2 - 2^(-20 * x + 10)), x), x, 0.5, 1) )$ draw2d(color=red, explicit( diff(0.5 * 2^(20 * x - 10), x, 2), x, 0, 0.5), color=blue, explicit(diff(0.5 * (2 - 2^(-20 * x + 10)), x, 2), x, 0.5, 1) )$ /* Circ */ easeInCirc(x) := 1.0 - sqrt(1.0 - x^2); plot2d(easeInCirc(x), [x, 0, 1])$ plot2d(diff(easeInCirc(x), x), [x, 0, 1])$ plot2d(diff(easeInCirc(x), x, 2), [x, 0, 1])$ easeOutCirc(x) := sqrt(1.0 - (x - 1.0)^2); plot2d(easeOutCirc(x), [x, 0, 1])$ plot2d(diff(easeOutCirc(x), x), [x, 0, 1])$ plot2d(diff(easeOutCirc(x), x, 2), [x, 0, 1])$ easeInOutCirc(x) := if x < 0.5 then 0.5 * (1.0 - sqrt(1.0 - (2.0 * x)^2)) else 0.5 * (sqrt(1.0 - (2.0 - 2.0 * x)^2) + 1.0); plot2d(easeInOutCirc(x), [x, 0, 1])$ draw2d(color=red, explicit( diff(0.5 * (1.0 - sqrt(1.0 - (2.0 * x)^2)), x), x, 0, 0.5), color=blue, explicit(diff(0.5 * (sqrt(1.0 - (2.0 - 2.0 * x)^2) + 1.0), x), x, 0.5, 1) )$ draw2d(color=red, explicit( diff(0.5 * (1.0 - sqrt(1.0 - (2.0 * x)^2)), x, 2), x, 0, 0.5), color=blue, explicit(diff(0.5 * (sqrt(1.0 - (2.0 - 2.0 * x)^2) + 1.0), x, 2), x, 0.5, 1) )$ /* Back */ easeInBack(x) := (1.70158 + 1.0) * x^3 - 1.70158 * x^2$ plot2d(easeInBack(x), [x, 0, 1])$ plot2d(diff(easeInBack(x), x), [x, 0, 1])$ plot2d(diff(easeInBack(x), x, 2), [x, 0, 1])$ easeOutBack(x) := 1.0 + (1.70158 + 1.0) * (x - 1.0)^3 + 1.70158 * (x - 1.0)^2$ plot2d(easeOutBack(x), [x, 0, 1])$ plot2d(diff(easeOutBack(x), x), [x, 0, 1])$ plot2d(diff(easeOutBack(x), x, 2), [x, 0, 1])$ easeInOutBack(x) := block([c2: 1.70158 * 1.525], if x < 0.5 then 0.5 * (2 * x)^2 * ((c2 + 1) * 2 * x - c2) else 0.5 * ((2 * x - 2.0)^2 * ((c2 + 1.0) * (2 * x - 2) + c2) + 2) )$ plot2d(easeInOutBack(x), [x, 0, 1])$ draw2d(color=red, explicit( diff(0.5 * (2 * x)^2 * ((1.70158 * 1.525 + 1) * 2 * x - 1.70158 * 1.525), x), x, 0, 0.5), color=blue, explicit(diff(0.5 * ((2 * x - 2.0)^2 * ((1.70158 * 1.525 + 1.0) * (2 * x - 2) + 1.70158 * 1.525) + 2), x), x, 0.5, 1) )$ draw2d(color=red, explicit( diff(0.5 * (2 * x)^2 * ((1.70158 * 1.525 + 1) * 2 * x - 1.70158 * 1.525), x, 2), x, 0, 0.5), color=blue, explicit( diff( 0.5 * ((2 * x - 2.0)^2 * ((1.70158 * 1.525 + 1.0) * (2 * x - 2) + 1.70158 * 1.525) + 2), x, 2), x, 0.5, 1) )$ /* Elastic */ easeInElastic(x) := block([c4: 2 * %pi / 3], if (x # 0 or x # 1) then -2^(10 * x - 10) * sin((10 * x - 10.75) * c4) else x )$ plot2d(easeInElastic(x), [x, 0, 1])$ plot2d(diff(-2^(10 * x - 10) * sin((10 * x - 10.75) * (2 * %pi / 3)), x), [x, 0, 1])$ plot2d(diff(-2^(10 * x - 10) * sin((10 * x - 10.75) * (2 * %pi / 3)), x, 2), [x, 0, 1])$ easeOutElastic(x) := block([c4: 2 * %pi / 3], if (x # 0 or x # 1) then 2^(-10 * x) * sin((10 * x - 0.75) * c4) + 1 else x )$ plot2d(easeOutElastic(x), [x, 0, 1])$ plot2d(diff(2^(-10 * x) * sin((10 * x - 0.75) * (2 * %pi / 3)) + 1, x), [x, 0, 1])$ plot2d(diff(2^(-10 * x - 10) * sin((10 * x - 0.75) * (2 * %pi / 3)) + 1, x, 2), [x, 0, 1])$ easeInOutElastic(x) := block([c5: 2 * %pi / 4.5], if (x # 0 or x # 1) then if x < 0.5 then -0.5 * 2^(20 * x - 10) * sin((20 * x - 11.125) * c5) else 0.5 * 2^(-20 * x + 10) * sin((20 * x - 11.125) * c5) + 1 else x )$ plot2d(easeInOutElastic(x), [x, 0, 1])$ draw2d(color=red, explicit( diff(-0.5 * 2^(20 * x - 10) * sin((20 * x - 11.125) * (2 * %pi / 4.5)), x), x, 0, 0.5), color=blue, explicit(diff(0.5 * 2^(-20 * x + 10) * sin((20 * x - 11.125) * (2 * %pi / 4.5)) + 1, x), x, 0.5, 1) )$ draw2d(color=red, explicit( diff(-0.5 * 2^(20 * x - 10) * sin((20 * x - 11.125) * (2 * %pi / 4.5)), x, 2), x, 0, 0.5), color=blue, explicit(diff(0.5 * 2^(-20 * x + 10) * sin((20 * x - 11.125) * (2 * %pi / 4.5)) + 1, x, 2), x, 0.5, 1) )$ /* Bounce */ easeInBounce(x) := 1 - easeOutBounce(1 - x)$ plot2d(easeInBounce(x), [x, 0, 1])$ draw2d(color=red, explicit(diff(1 - 7.5625 * x * x, x), x, 0, 1 / 2.75), color=green, explicit(diff(1 - 7.5625 * (x - 1.5 / 2.75)^2 - 0.75, x), x, 1 / 2.75, 2 / 2.75), color=blue, explicit(diff(1 - 7.5625 * (x - 2.25 / 2.75)^2 - 0.9375, x), x, 2 / 2.75, 2.5 / 2.75), color=yellow, explicit(diff(1 - 7.5625 * (x - 2.625 / 2.75)^2 - 0.984375, x), x, 2.5 / 2.75, 1) )$ draw2d(color=red, explicit(diff(1 - 7.5625 * x * x, x, 2), x, 0, 1 / 2.75), color=green, explicit(diff(1 - 7.5625 * (x - 1.5 / 2.75)^2 - 0.75, x, 2), x, 1 / 2.75, 2 / 2.75), color=blue, explicit(diff(1 - 7.5625 * (x - 2.25 / 2.75)^2 - 0.9375, x, 2), x, 2 / 2.75, 2.5 / 2.75), color=yellow, explicit(diff(1 - 7.5625 * (x - 2.625 / 2.75)^2 - 0.984375, x, 2), x, 2.5 / 2.75, 1) )$ easeOutBounce(x) := block([n1: 7.5625, d1: 2.75], if (x < 1 / d1) then n1 * x * x else if (x < 2 / d1) then n1 * (x - 1.5 / d1)^2 + 0.75 else if (x < 2.5 / d1) then n1 * (x - 2.25 / d1)^2 + 0.9375 else n1 * (x - 2.625 / d1)^2 + 0.984375 )$ plot2d(easeOutBounce(x), [x, 0, 1])$ draw2d(color=red, explicit(diff(7.5625 * x * x, x), x, 0, 1 / 2.75), color=green, explicit(diff(7.5625 * (x - 1.5 / 2.75)^2 + 0.75, x), x, 1 / 2.75, 2 / 2.75), color=blue, explicit(diff(7.5625 * (x - 2.25 / 2.75)^2 + 0.9375, x), x, 2 / 2.75, 2.5 / 2.75), color=yellow, explicit(diff(7.5625 * (x - 2.625 / 2.75)^2 + 0.984375, x), x, 2.5 / 2.75, 1) )$ draw2d(color=red, explicit(diff(7.5625 * x * x, x, 2), x, 0, 1 / 2.75), color=green, explicit(diff(7.5625 * (x - 1.5 / 2.75)^2 + 0.75, x, 2), x, 1 / 2.75, 2 / 2.75), color=blue, explicit(diff(7.5625 * (x - 2.25 / 2.75)^2 + 0.9375, x, 2), x, 2 / 2.75, 2.5 / 2.75), color=yellow, explicit(diff(7.5625 * (x - 2.625 / 2.75)^2 + 0.984375, x, 2), x, 2.5 / 2.75, 1) )$ easeInOutBounce(x) := if x < 0.5 then 0.5 * (1 - easeOutBounce(1 - 2 * x)) else 0.5 * (1 + easeOutBounce(2 * x - 1))$ plot2d(easeInOutBounce(x), [x, 0, 1])$ draw2d(color=red, explicit(diff(0.5 * (1 - 7.5625 * (1 - 2 * x)^2), x), x, 0, 1 / 2.75), color=green, explicit(diff(0.5 * (1 - 7.5625 * ((1 - 2 * x) - 1.5 / 2.75)^2 - 0.75), x), x, 1 / 2.75, 0.5), color=orange, explicit(diff(0.5 * (1 + 7.5625 * ((2 * x - 1) - 1.5 / 2.75)^2 + 0.75), x), x, 0.5, 2 / 2.75), color=blue, explicit(diff(0.5 * (1 + 7.5625 * ((2 * x - 1) - 2.25 / 2.75)^2 + 0.9375), x), x, 2 / 2.75, 2.5 / 2.75), color=yellow, explicit(diff(0.5 * (1 + 7.5625 * ((2 * x - 1) - 2.625 / 2.75)^2 + 0.984375), x), x, 2.5 / 2.75, 1) )$ draw2d(color=red, explicit(diff(0.5 * (1 - 7.5625 * (1 - 2 * x)^2), x, 2), x, 0, 1 / 2.75), color=green, explicit(diff(0.5 * (1 - 7.5625 * ((1 - 2 * x) - 1.5 / 2.75)^2 - 0.75), x, 2), x, 1 / 2.75, 0.5), color=orange, explicit(diff(0.5 * (1 + 7.5625 * ((2 * x - 1) - 1.5 / 2.75)^2 + 0.75), x, 2), x, 0.5, 2 / 2.75), color=blue, explicit(diff(0.5 * (1 + 7.5625 * ((2 * x - 1) - 2.25 / 2.75)^2 + 0.9375), x, 2), x, 2 / 2.75, 2.5 / 2.75), color=yellow, explicit(diff(0.5 * (1 + 7.5625 * ((2 * x - 1) - 2.625 / 2.75)^2 + 0.984375), x, 2), x, 2.5 / 2.75, 1) )$

基础噪声

从这里开始会不断介绍 ShaderToy 中常见的噪声算法, 掌握之后就可以看懂相当一部分的 ShaderToy 项目了.

随机函数

参考资料如下:

https://thebookofshaders.com/10/

https://iquilezles.org/articles/sfrand/

在讨论随机函数前先了解一下什么是随机, 人们口中的随机一般是指数学中定义的随机: 不可预测(

unpredictable)和不可重现.可预测就意味着可以确定一个事件必定发生或不发生, 可重现意味着可以通过固定方法使得一个事件发生或不发生.

而计算机中的代码是死板且可以预测的, 那又是如何产生随机数呢?

对于计算机, 有两种随机, 分别如下:

确定性随机 (

deterministic random)用算法生成一个数列, 该数列的特性接近随机数列的特性, 然后根据参数从该数列获取一个数字作为随机数, 通过相同参数可以获得相同随机数,

这种随机可以通过算法和参数来预测随机数, 因此也被称为伪随机 (

pseudo-random). 数据结构中的哈希函数 (hash) 就属于伪随机函数.非确定性随机 (

non-deterministic random)这种随机是不可预测和不可重现的, 可以被认为是真随机(

truely random), 它的随机数不是通过算法来生成的, 而是来源于物理现象, 比如电子噪声, 量子效应, 大气噪声和用户输入等等.

Linux的 /dev/random 就是从环境噪声获取随机数.若感兴趣, 可以看一下这个视频: 计算机如何生成(伪)随机.

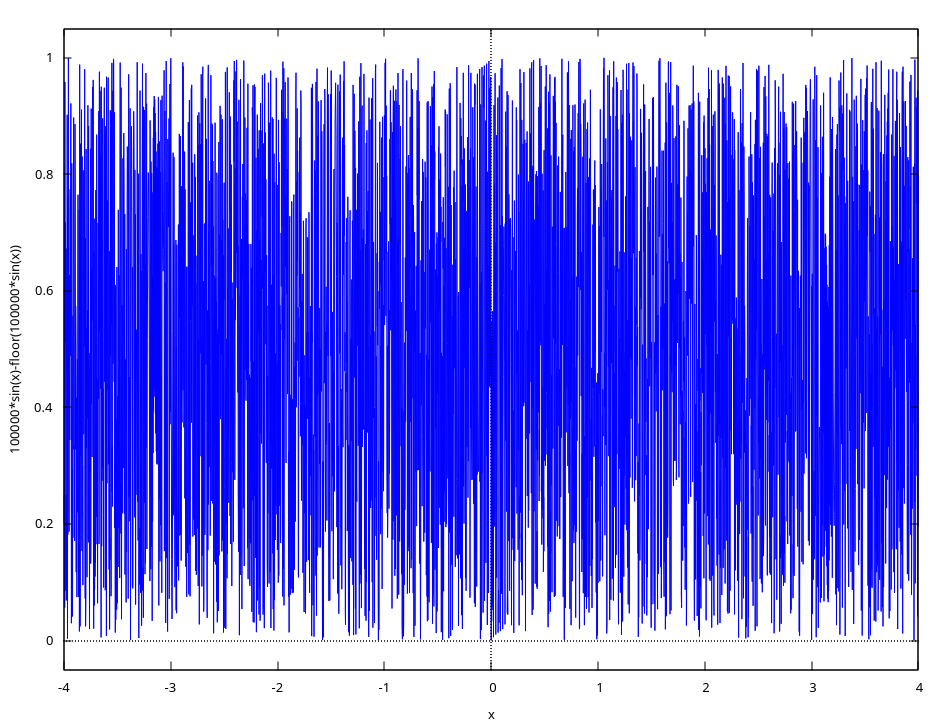

Shader 里用的是确定性随机函数, 需要开发人员自己实现的, 确定性随机函数本质上是一个周期函数,

比如 \(\sin\), 并把它的值域限定在 \([0, 1]\) 上.

float rand = fract(sin(x)); // 限制在 [0, 1] 的范围内

你可能觉得这个随机数看作不够随机, 那就让它们看起来更加混乱吧.

float rand = fract(sin(x) * 10000.0);

即便它看着混乱随机, 但仍是可以预测.

随机数的生成并不只有一种算法, 你可以充分使用自己的知识去创建随机函数.

比如, Iquilezles 提供了一个更好的随机数方案, 有兴趣的可以看一下.

一般来说, 编程语言中提供的随机函数都是像这个 \(rand\) 一样服从均匀分布的.

在实际开发中偶尔想让随机函数服从特定分布, 想要控制随机数的分布, 根据均匀分布的普遍性,

可以对服从均匀分布的随机数 \(X\) 进行变换成服从其它分布的随机数 \(Y\), 这需要掌握一定的概率论知识,

在我的概率论学习笔记中有写到具体的程序实现思路, 以下是符合指数分布的随机函数的 GLSL 实现:

float inverse_cdf_exponential(float u, float lambda) { return -log(1.0 - u) / lambda; } float exponential_random(float x, float lambda) { float u = fract(sin(x) * 10000.0); return inverse_cdf_exponential(u, lambda); }

另外, Pixelero 也发布了一片文章来介绍服从一些分布的随机数函数.

高维随机函数

在 Shader 开发中通常需要根据纹理坐标来生成随机数, 而上面介绍的 \(rand\) 是一个 1D 随机函数, 并不能很好地满足需求, 这需要 2D 随机函数.

同理, 也存在 3D 和 4D 甚至更高维的随机函数.

假设高维随机函数 \(f\) 是一个以 \(n\) 维向量 \(v \in \mathbb{R}^n\) 作为输入, 以标量 \(r\) 作为输出: \(r = f(v)\).

其实高维随机函数的实现思路其实和 1D 随机函数差不多, 只不过要对 \(v\) 做计算, 其计算结果是一个标量 \(i\) , 最后用 \(i\) 作为 1D 随机函数 \(g\) 的输入得出 \(r = g(i)\).

把向量转换成标量的话, 首先想到的是点积运算, 来看一个例子:

float rand(vec2 st) { return fract(sin(dot(st.xy, vec2(12.9898, 78.233))) * 43758.5453123); }

向量值函数形式的随机函数

这种随机函数是用来生成向量的, 在 Shader 开发中通常是用来根据坐标计算出对应片元的颜色, 这种函数既可以用标量, 也可以用向量作为输入, 最后以向量作为输出.

比如下面这个例子, 以 2D 向量作为输入和输出:

// https://www.shadertoy.com/view/lldyDn vec2 rand(vec2 p) { vec3 p3 = fract(vec3(p.xyx) * vec3(.1031, .1030, .0973)); p3 += dot(p3, p3.yzx+19.19); return fract((p3.xx+p3.yz) * p3.zy); }

比如以 3D 向量作为输入和输出:

vec3 rand(vec3 v) { vec3 p = vec3(dot(v, vec3(127.1, 311.7, 74.7)), dot(v, vec3(269.5, 183.3, 246.1)), dot(v, vec3(113.5, 271.9, 124.6))); return fract(sin(p) * 43758.5453123); }

比如以 2D 向量作为输入, 以 3D 向量作为输出:

vec3 rand(vec2 v) { v -= 0.00001727738; float z = fract(tan(v.x*3.14+v.y))*10.751135; vec3 a = fract(vec3(v.x/1.000383,v.y/1.000401,z)*3.14)*10.8372611876; float w = fract(dot(a, vec3(1.3774, 8.2446, 2.2883)))*10.0973326; return fract(7.817082*tan(9.726749*reflect(a, vec3(w, z, fract(z*43.28)*10.114865)))); }

三角函数的缺陷

在 WebGL 或 OpenGL 中, \(\sin\) 的实现取决于机器, 这导致了同一段 Shader 代码在不同平台上的效果不一样.

Iquilezles 后来总结了一些算法来规避这个问题:

// https://www.shadertoy.com/view/llGSzw float hash11 ( uint n ) { // integer hash copied from Hugo Elias n = (n << 13U) ^ n; n = n * (n * n * 15731U + 789221U) + 1376312589U; return float( n & uint(0x7fffffffU))/float(0x7fffffff); } vec3 hash13( uint n ) { // integer hash copied from Hugo Elias n = (n << 13U) ^ n; n = n * (n * n * 15731U + 789221U) + 1376312589U; uvec3 k = n * uvec3(n,n*16807U,n*48271U); return vec3( k & uvec3(0x7fffffffU))/float(0x7fffffff); } // https://www.shadertoy.com/view/4tXyWN uint hash21( uvec2 p ) { p *= uvec2(73333,7777); p ^= (uvec2(3333777777)>>(p>>28)); uint n = p.x*p.y; return float(n^(n>>15)) * (1.0 / float(0xffffffffU)); } // https://www.shadertoy.com/view/XlXcW4 vec3 hash33( uvec3 p ) { const uint k = 1103515245U; // GLIB C //const uint k = 134775813U; // Delphi and Turbo Pascal //const uint k = 20170906U; // Today's date (use three days ago's dateif you want a prime) //const uint k = 1664525U; // Numerical Recipes p = ((p>>8U)^p.yzx) * k; p = ((p>>8U)^p.yzx) * k; p = ((x>>8U)^p.yzx) * k; return vec3(x) * (1.0 / float(0xffffffffU)); }

不过这些随机函数还不够齐全, 所以从 Orels' Tips 摘抄了一个较为全面的实现, 并进行了调整:

// 1 out, 1 in... float chash11(float p) { p = fract(p * .1031); p *= p + 33.33; p *= p + p; return fract(p); } //---------------------------------------------------------------------------------------- // 1 out, 2 in... float chash12(vec2 p) { vec3 p3 = fract(vec3(p.xyx) * .1031); p3 += dot(p3, p3.yzx + 33.33); return fract((p3.x + p3.y) * p3.z); } //---------------------------------------------------------------------------------------- // 1 out, 3 in... float chash13(vec3 p3) { p3 = fract(p3 * .1031); p3 += dot(p3, p3.zyx + 31.32); return fract((p3.x + p3.y) * p3.z); } //---------------------------------------------------------------------------------------- // 2 out, 1 in... vec2 chash21(float p) { vec3 p3 = fract( p * vec3(.1031, .1030, .0973) ); p3 += dot(p3, p3.yzx + 33.33); return fract((p3.xx+p3.yz)*p3.zy); } //---------------------------------------------------------------------------------------- /// 2 out, 2 in... vec2 chash22(vec2 p) { vec3 p3 = fract(vec3(p.xyx) * vec3(.1031, .1030, .0973)); p3 += dot(p3, p3.yzx+33.33); return fract((p3.xx+p3.yz)*p3.zy); } //---------------------------------------------------------------------------------------- /// 2 out, 3 in... vec2 chash23(vec3 p3) { p3 = fract(p3 * vec3(.1031, .1030, .0973)); p3 += dot(p3, p3.yzx+33.33); return fract((p3.xx+p3.yz)*p3.zy); } //---------------------------------------------------------------------------------------- // 3 out, 1 in... vec3 chash31(float p) { vec3 p3 = fract(p * vec3(.1031, .1030, .0973)); p3 += dot(p3, p3.yzx+33.33); return fract((p3.xxy+p3.yzz)*p3.zyx); } //---------------------------------------------------------------------------------------- /// 3 out, 2 in... vec3 chash32(vec2 p) { vec3 p3 = fract(vec3(p.xyx) * vec3(.1031, .1030, .0973)); p3 += dot(p3, p3.yxz+33.33); return fract((p3.xxy+p3.yzz)*p3.zyx); } //---------------------------------------------------------------------------------------- /// 3 out, 3 in... vec3 chash33(vec3 p3) { p3 = fract(p3 * vec3(.1031, .1030, .0973)); p3 += dot(p3, p3.yxz+33.33); return fract((p3.xxy + p3.yxx)*p3.zyx); } //---------------------------------------------------------------------------------------- // 4 out, 1 in... vec4 chash41(float p) { vec4 p4 = fract( p * vec4(.1031, .1030, .0973, .1099)); p4 += dot(p4, p4.wzxy+33.33); return fract((p4.xxyz+p4.yzzw)*p4.zywx); } //---------------------------------------------------------------------------------------- // 4 out, 2 in... vec4 chash42(vec2 p) { vec4 p4 = fract(vec4(p.xyxy) * vec4(.1031, .1030, .0973, .1099)); p4 += dot(p4, p4.wzxy+33.33); return fract((p4.xxyz+p4.yzzw)*p4.zywx); } //---------------------------------------------------------------------------------------- // 4 out, 3 in... vec4 chash43(vec3 p) { vec4 p4 = fract(vec4(p.xyzx) * vec4(.1031, .1030, .0973, .1099)); p4 += dot(p4, p4.wzxy+33.33); return fract((p4.xxyz+p4.yzzw)*p4.zywx); } //---------------------------------------------------------------------------------------- // 4 out, 4 in... vec4 chash44(vec4 p4) { p4 = fract(p4 * vec4(.1031, .1030, .0973, .1099)); p4 += dot(p4, p4.wzxy+33.33); return fract((p4.xxyz+p4.yzzw)*p4.zywx); }

按照哈希函数去实现的随机函数也很常见, 这种函数方便预计算:

float mod289(float x) { return x - floor(x * (1.0 / 289.0)) * 289.0; } vec2 mod289(vec2 x) { return x - floor(x * (1.0 / 289.0)) * 289.0; } vec3 mod289(vec3 x) { return x - floor(x * (1.0 / 289.0)) * 289.0; } vec4 mod289(vec4 x) { return x - floor(x * (1.0 / 289.0)) * 289.0; } // mod(34.0 * x * x + 10.0 * x, 289.0) /* 34.0 * x * x + 10.0 * x 为非线性函数, 该函数具备雪崩效应(avalanche effect), 即输入发生微小改变会导致输出发生巨大且不可预测的变化, 或者说具备较大的非常数导数 */ float permute(float x) { return mod289(((x*34.0)+10.0)*x); } vec2 permute(vec2 x) { return mod289(((x*34.0)+10.0)*x); } vec3 permute(vec3 x) { return mod289(((x*34.0)+10.0)*x); } vec4 permute(vec4 x) { return mod289(((x*34.0)+10.0)*x); }

个人很喜欢该实现, 因为相比前面的实现来说太简单.

该实现的理论基础是同余方程(

Nonlinear Congruence Equation)中的二次同余: \(kx^2 + bx + c \equiv a \pmod{m}\).奈何本人对数论不太熟悉, 所以这里就只留一个线索待日后探索.

噪声函数

噪声 (noise) 也是一种随机, 但相比一般的随机, 噪声的过度显得更加平滑, 更自然, 适合用来生成丰富的视觉效果, 因此, 噪声也被成为平滑随机性 (smooth randomness).

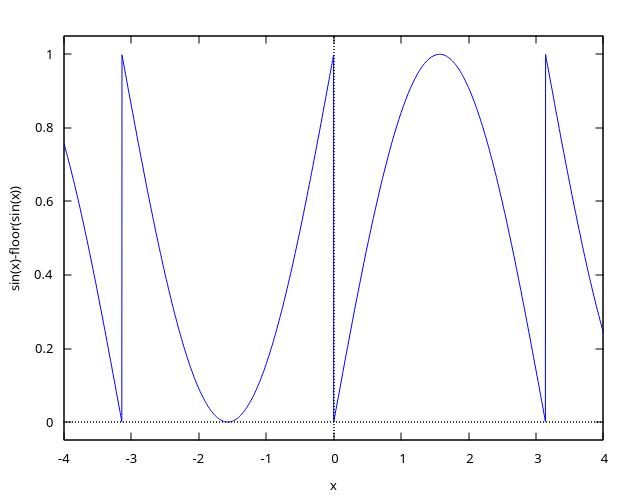

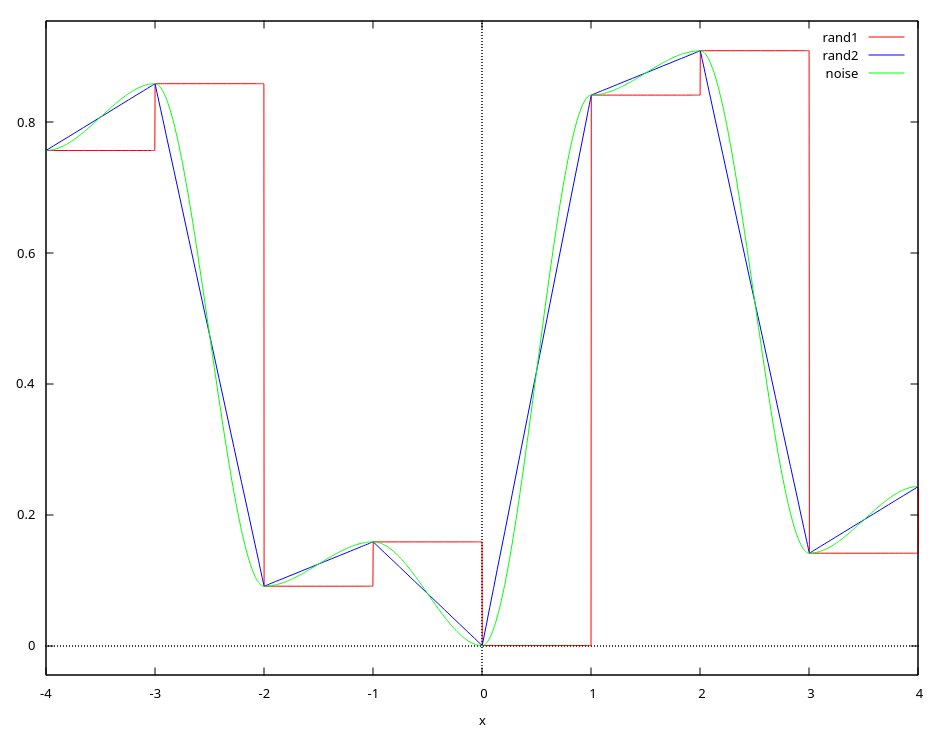

先来感受一下, 随机函数和噪音函数之间的区别, 以下是分别是随机函数 \(rand1(x)\), \(rand2(x)\) 和噪声函数 \(noise(x)\) 的 Maxima 的实现以及对应的函数图像:

fract(x) := x - floor(x)$ mix(x, y, a) := x * (1 - a) + y * a$ smoothstep(l, u, x) := block( t: min(max((x - l) / (u - l), 0.0), 1.0), return (t * t * (3 - 2 * t)) )$ rand(x) := fract(sin(x))$ /* 随机算法以及它们的图像 */ rand1(x) := rand(floor(x))$ rand2(x) := mix(rand(floor(x)), rand(floor(x) + 1), fract(x))$ noise(x) := mix(rand(floor(x)), rand(floor(x) + 1), smoothstep(0, 1, fract(x)))$ plot2d([rand1(x), rand2(x), noise(x)], [x, -4, 4], [color, red, blue, green], [legend, "rand1", "rand2", "noise"])$

正如图片所示, 令 \(z = floor(x)\), 从 \(rand1\) 到 \(rand2\), 为随机数 \(rand1(z)\) 和 \(rand1(z + 1.0)\) 之间引入了线性插值, 从 \(rand2\) 到 \(noise\), 为随机数 \(rand1(z)\) 和 \(rand1(z + 1.0)\) 之间引入了非线性插值, 函数图像变得越来越平滑.

\(noise\) 的算法可以看作是在一条线上的两个点之间进行插值, 这个点是根据参数 \(x\) 来决定的, 以 \([floor(x), floor(x) + 1]\) 作为插值范围来保证变化间隔为 1, 以 \(x\) 的小数部分 \(fract(x)\) 作为插值参数, 从而得出噪声值.

在实际应用中, 可以根据自身需求替换插值方法, 比如想换函数 \(g\) 来进行插值: \(f(a, b, t) = (1 - g(t)) \cdot a - g(t) \cdot b\),

而 \(noise\) 函数里面的 \(g(t) = smoothstep(0, 1, t)\);

当 \(g(t) = \frac{1 - \cos(\pi t)}{2}\) 时, \(f\) 被叫做余弦插值 (

Cosine Interpolation);另外一个比较有名的插值函数是五次插值曲线: \(g(t) = 6t^5 - 15t^4 + 10t^3\), 是 \(smoothstep\) 的改进替代.

GLSL 也提供了内置的噪音函数: noise, 但对于创意工作而言,

这个内置函数并不能完全满足创作者的需求, 所以基本上都是自己实现噪声函数, 或者使用第三方实现, 比如 lygia/generative.

噪声算法有很多, 很多艺术创作者会根据需求来选择合适的噪声算法来进行艺术创作, 比如柏林噪声算法(Perlin Noise Algorithm),

接下来会介绍三种比较基础的噪声算法: 值噪声, 梯度噪声以及单形噪声.

值噪声

如上面的 1D 噪声所示, 可以看作是一线条上 \(2^1\) 个点对应的随机数之间的插值, 而 2D 噪声可以看作是一个矩形上 \(2^2\) 个角对应的随机数之间的插值, 如此类推, 3D 噪声可以看作立方体上 \(2^3\) 个角对应的随机数之间的插值.

这种对随机数进行插值得到噪声被称为值噪声 (value noise).

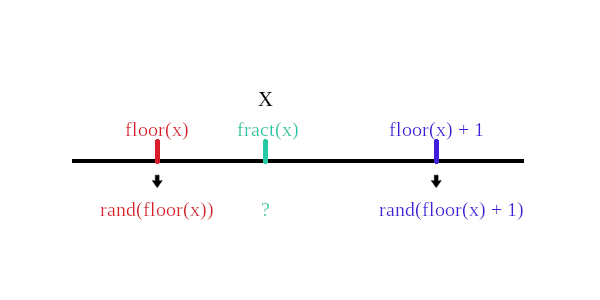

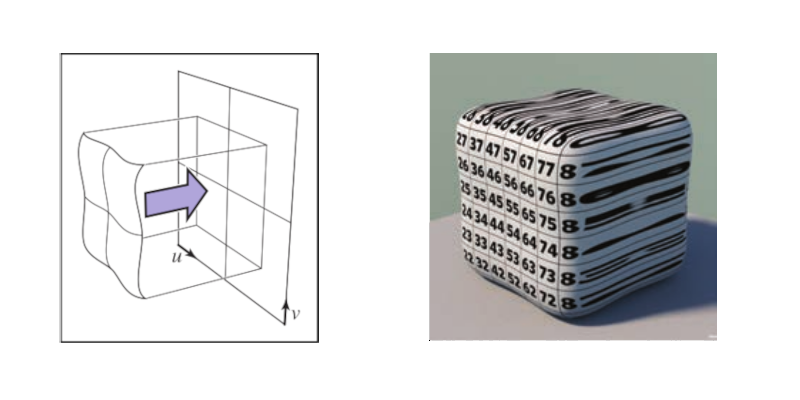

双线性插值法 (

bilinear interpolation)根据平面的 4 个角进行插值的技巧需要参考双线性插值法, 这种技巧也可以解决贴图在缩放显示时出现的纹理不平滑问题,

如图所示, 想要计算出平面中 \(C\) 的坐标, 可先从 \(X\) 轴方向(\(TL \rightarrow TR\))进行插值,

首先计算出 \(CT = (1 - f_x) \cdot TL + f_x \cdot TR\),

再计算出 \(CB = (1 - f_x) \cdot BL + f_x \cdot BR\),

最后从 \(Y\) 轴方向进行插值计算出 \(C = (1 - f_y) \cdot CT + f_y \cdot CB\).

或者也可以先从 \(Y\) 轴方向(\(TL \rightarrow BL\))进行插值, 最后再从 \(X\) 轴方向进行插值, 结果都一样, 就不赘述了.

其

GLSL如下:float ct = mix(tl, tr, fx); float cb = mix(bl, br, fx); float c = mix(ct, cb, fy); // 有时候你可能看到的插值实现可能是下面这样的 /* ct = tl * (1 - fx) + tr * fx cb = bl * (1 - fx) + br * fx c = [tl * (1 - fx) + tr * fx] * (1 - fy) + [bl * (1 - fx) + br * fx] * fy = [tl * (1 - fx) + tr * fx] - [tl * (1 - fx) + tr * fx] * fy + [bl * (1 - fx) + br * fx] * fy = [tl * (1 - fx) + tr * fx] + [ bl * (1 - fx) + br * fx - tl * (1 - fx) - tr * fx ] * fy = [tl * (1 - fx) + tr * fx] + [(bl - tl) * (1 - fx) + (br - tr) * fx] * fy = mix(tl, tr, fx) + [(bl - tl) * (1 - fx) + (br - tr) * fx] * fy */三线性插值法 (

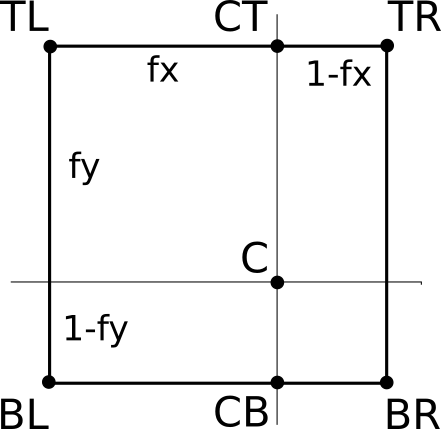

trilinear interpolation)根据立方体的 8 个角进行插值的技巧需要参考三线性插值法, 这种方法可以看作两个对立面的双线性插值随后加上一个线性插值.

需要注意的是, 这张图的 \(Y\) 轴方向是 \(c000 \rightarrow c010\), 其三线性插值的

GLSL实现如下:// 平面 c000 - c100 - c110 - c010 的双线性插值 float a = mix(c010, c110, tx); float b = mix(c000, c110, tx); float e = mix(b, a, ty); // 平面 c001 - c101 - c111 - c011 的双线性插值 float c = mix(c001, c111, tx); float d = mix(c001, c101, tx); float f = mix(d, c, ty); // 对 e 和 f 进行线性插值 float g = mix(e, f, tz);

以 2D 噪声为例, 首先, 根据纹理坐标 \(st\) 来确定其所处网格(lattice)的 4 个角的坐标:

\((floor(st.x), floor(st.y))\)

\((floor(st.x) + 1.0, floor(st.y))\)

\((floor(st.x), floor(st.y) + 1.0)\)

\((floor(st.x) + 1.0, floor(st.y) + 1.0)\)

另外, \((fract(st.x), fract(st.y))\) 就是 \(st\) 相对于网格的坐标.

然后, 以这 4 个坐标作为随机函数的参数得到 4 个随机值,

最后, 根据这 4 个随机值进行双线性插值得到 \(st\) 所对应的随机值.

// 来自 https://thebookofshaders.com/11/ float rand(vec2 st) { return fract(sin(dot(st.xy, vec2(12.9898, 78.233))) * 43758.5453123); } float noise (in vec2 st) { vec2 i = floor(st); vec2 f = fract(st); // Four corners in 2D of a tile which is created according to st. float a = rand(i); float b = rand(i + vec2(1.0, 0.0)); float c = rand(i + vec2(0.0, 1.0)); float d = rand(i + vec2(1.0, 1.0)); // Smooth Interpolation // Cubic Hermine Curve. Same as SmoothStep() vec2 u = f*f*(3.0-2.0*f); // u = smoothstep(0.,1.,f); // Mix 4 coorners percentages return mix(a, b, u.x) + (c - a)* u.y * (1.0 - u.x) + (d - b) * u.x * u.y; } void main() { vec2 st = gl_FragCoord.xy/iResolution.xy; // Scale the coordinate system to see // some noise in action vec2 pos = vec2(st * 5.0); // Use the noise function float n = noise(pos); gl_FragColor = vec4(vec3(n), 1.0); }

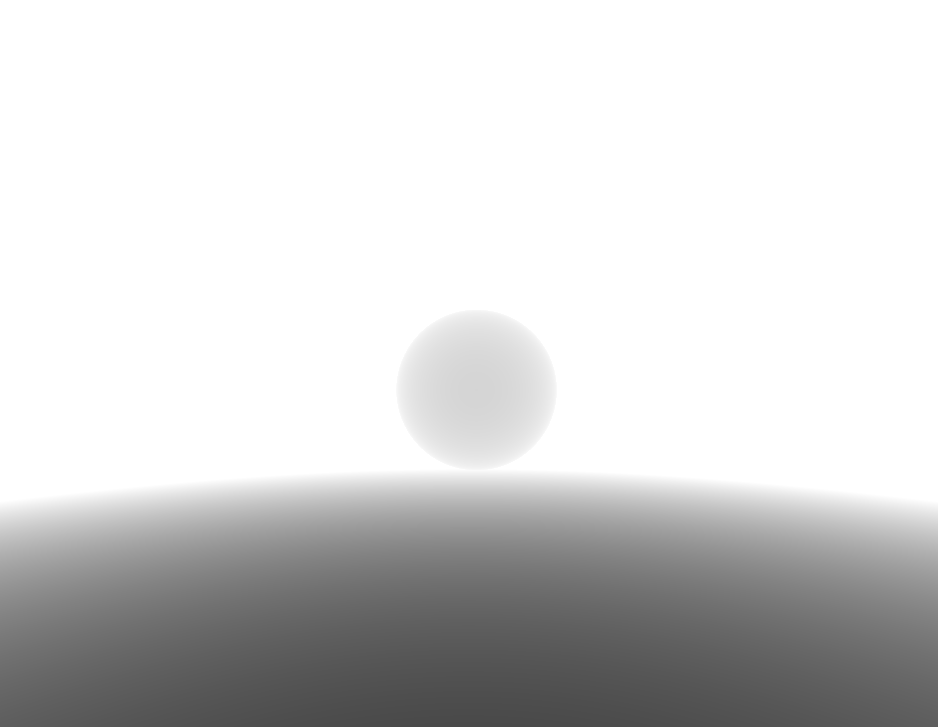

其效果如下:

Figure 16: 2D 值噪声的效果

梯度噪声

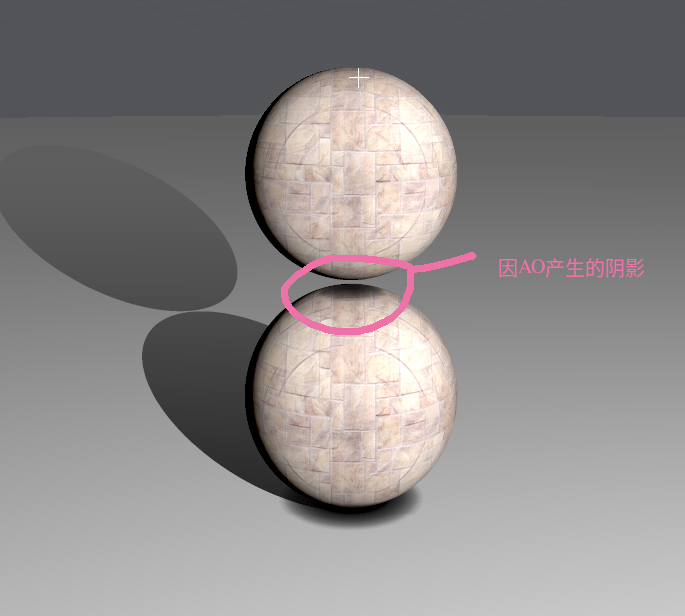

一般来说, 值噪声的效果就如上图所示的那样, 看起来一块一块的, 为了消除块状效果, Ken Perlin 在 1985 年开发出了另外一种噪声算法, 得到噪声的叫梯度噪声 (Gradient Noise), 这个算法也就是人们熟知的柏林函数.

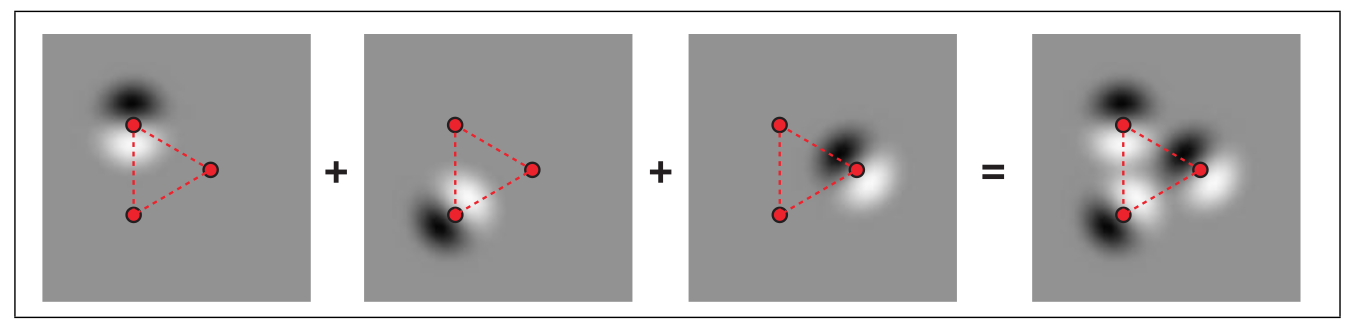

和值噪声算法的区别在于, 梯度噪声的随机函数以方向(vec2/vec3/vec4)作为输出, 值噪声的随机函数以值(float)作为输出.

和值噪声的生成类似, 以 2D 梯度噪声为例, 通过随机函数为 4 个角生成梯度向量(需要归一化), 再通过点积运算把它们转换成 4 个标量,

之后的过程就与值噪声的计算一样. 在使用点积把梯度向量 \(\nabla\) 转换成标量时, 需要为每个角 \(p\) 计算出它的角指向(也称为距离向量),

假设 \(o\) 是网格内的坐标, 那么角指向为 \(v = (o.x - p.x, o.y - p.y)\), 最后计算角指向和梯度向量之间的点积 \(v \cdot \nabla\).

按照数学定义, 如果角指向是一个单位向量, 那么这个点积是方向导数, 换而言之, 梯度噪声的结果是一个类似方向导数的存在.

如下图所示, 绿色箭头为黄格字的梯度向量 \(\nabla\), 黄点为 \(o\), 蓝色箭头为角指向 \(v\).

按照该思路, 下面为 GLSL 的实现:

// 2D 向量值函数形式的随机函数 vec2 rand(vec2 st){ st = vec2(dot(st, vec2(127.1,311.7)), dot(st, vec2(269.5,183.3))); return -1.0 + 2.0 * fract(sin(st) * 43758.5453123); // 归一化 } // 类似前面 2D 噪声的生成, 但是 4 个角的随机值需要一番点积运算 float noise(vec2 st) { vec2 i = floor(st); vec2 f = fract(st); // vec2 u = f * f * (3.0 - 2.0 * f); vec2 u = smoothstep(vec2(0.0), vec2(1.0), f); // a,b,c,d 是四个网格上的梯度 // va,vb,vc,vd 是四个角指向 vec2 a = rand(i); vec2 va = f - vec2(0.0, 0.0); vec2 b = rand(i + vec2(1.0, 0.0)); vec2 vb = f - vec2(1.0, 0.0); vec2 c = rand(i + vec2(0.0, 1.0)); vec2 vc = f - vec2(0.0, 1.0); vec2 d = rand(i + vec2(1.0, 1.0)); vec2 vd = f - vec2(1.0, 1.0); float dotA = dot(a, va); float dotB = dot(b, vb); float dotC = dot(c, vc); float dotD = dot(d, vd); float ab = mix(dotA, dotB, u.x); float cd = mix(dotC, dotD, u.x); return mix(ab, cd, u.y); }

如果对于前面梯度和方向导数之类的名词不了解, 那么建议阅读一下这段科普, 后面很多地方都出现了它们的应用.

梯度的全称是梯度向量(

gradient vector), 源于微积分中标量值函数, 用来表示多元标量值函数 \(f\) 在各个分量上的变化率,这个变化率就是梯度向量, 以二维向量为例: \(\nabla f(x, y) = (\frac{\partial f}{\partial x}, \frac{\partial f}{\partial y})\).

梯度向量 \(\nabla f(x, y)\) 表示在所有方向中使得 \(f\) 的方向导数最大的那一个方向, 而 \(|\nabla f(x, y)|\) 表示最大方向导数的变化率大小.

在几何上, \(\nabla f(x, y)\) 是 \(f\) 在点 \((x, y)\) 上的法线向量.

方向导数 \(D_u f(x, y)\) 表示 \(f\) 在某点 \((x, y)\) 上往某方向 \(u\) (单位向量)的变化率:

\(D_u f(x, y) = \nabla f(x, y) \cdot u = |\nabla f(x, y)||u| \cos_{\theta}\), 其中 \(\theta\) 为 \(\nabla f(x, y)\) 和 \(u\) 之间的夹角.

当 \(\theta = 0\) 时, 换而言之当 \(\nabla f(x, y)\) 和 \(u\) 方向相同时, \(D_u f(x, y)\) 为最大.

把 \(D_{u}f(x, y)\) 看作是一个以方向 \(u\) 为参数的函数 \(g(u)\), 那么 \(\nabla f(x, y)\) 就是 \(g\) 关于 \(u\) 导数: \(\frac{\mathrm{d}g}{\mathrm{d}u}\).

为什么梯度噪声不对角指向进行单位化再计算? 因为梯度噪声的结果并不是用于测量某方向上的变化率, 而是用来生成视觉效果的,

单位化之后角指向的长度都一致了, 生产的梯度噪声就会少了点自然, 多了点重复的模式.

那么 1D 的梯度噪声呢? 一维空间是一条直线, 可以把直线上的点 \(p\) (p 是标量)看作一个一维向量 \((p)\), 一维向量之间的点积就是标量之间的乘积,

根据这些信息, 就可以实现 1D 梯度噪声了:

float rand(float p) { return fract(sin(p) * 43758.5453123); } float noise(float p) { float i = floor(p); float f = fract(p); float u = smoothstep(0.0, 1.0, f); // 这里的 rand(i) * 2.0 - 1.0 是要对梯度 rand(i) 进行归一化使其范围在 [-1, 1] 之间 float a = rand(i) * 2.0 - 1.0; float va = f - 0.0; float b = rand(i + 1.0) * 2.0 - 1.0; float vb = f - 1.0; float dotA = a * va; float dotB = b * vb; return 2.4 * mix(dotA, dotB, u); }

这里给出 1D 梯度噪声的实现的目的是, 解释为什么梯度噪声可以消除块状, 具体解释可以参考 ScratchAPixel - Perlin Noise 的 Why Is Perlin/Gradient Noise Better Than Value Noise 部分.

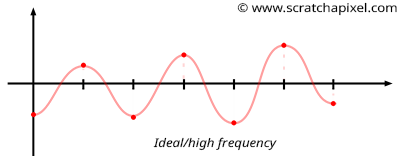

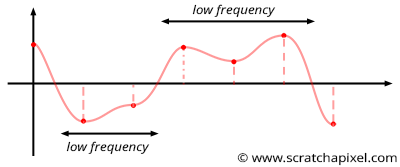

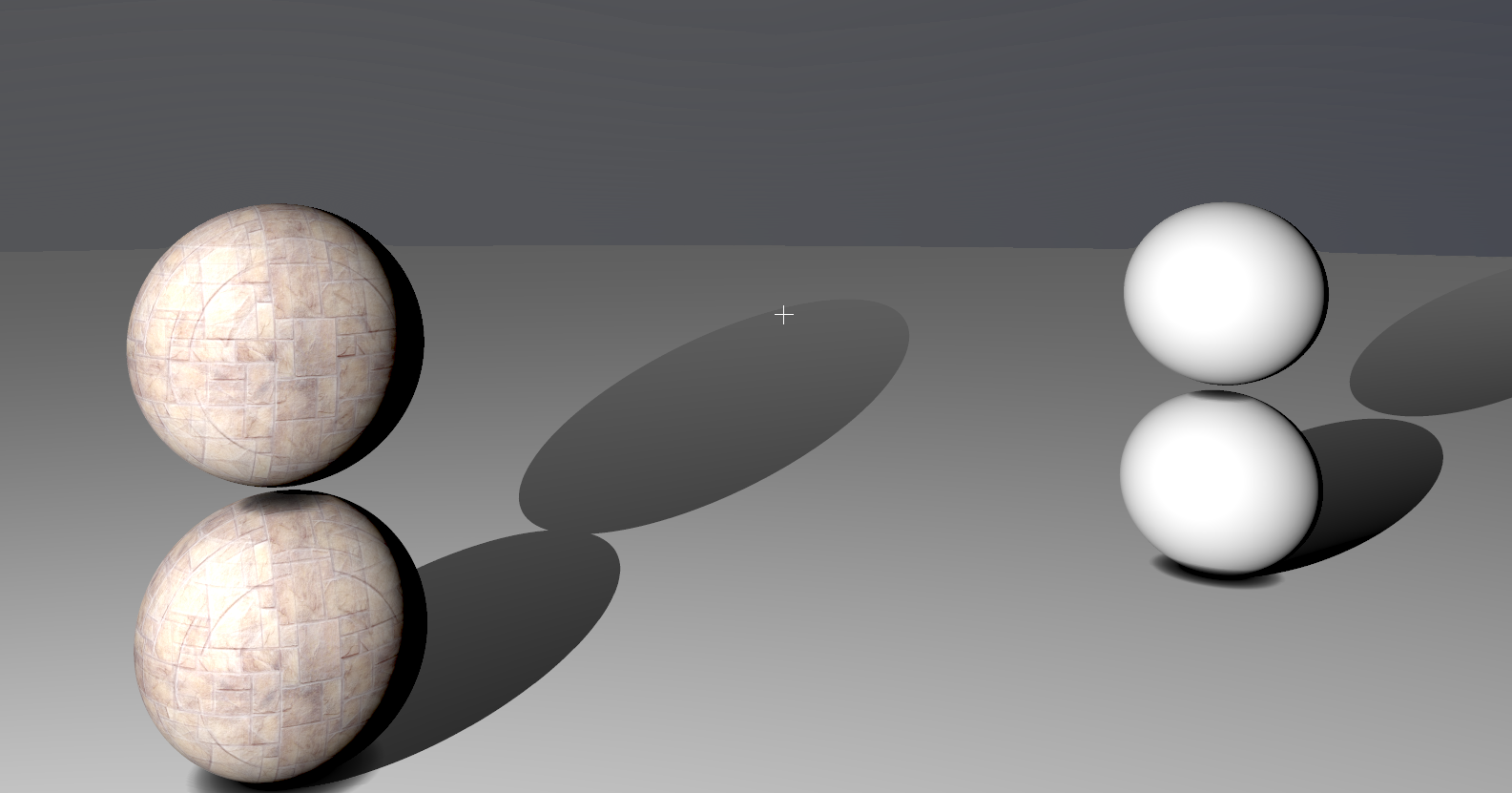

首先要理解块状效果的成因, 这需要理解高频(higher frequencies)和低频(lower frequencies)的概念:

我们把连续红点之间的变化作为对比, 变化相对大的叫做高频, 变化相对小的叫做低频.

Figure 17: 理想情况: 随机值关于 \(x\) 轴良好地分布, 使得噪声函数的振荡在频率上是成规律的.

Figure 18: 最坏情况: 一些随机值在 \(x\) 轴的一定范围内连续出现多次, 也就是说噪声函数的频率分布是不成规律的.

理想的噪声函数是以高频为主, 所以它看起来随机且局部变化平滑, 但总体上呈现出相当均匀的外观(homogeneous look), 也就是由相似频率构成.

值噪声则是由高频和低频构成, 也就是类似上面最坏情况, 低频部分就是方块效果的成因, 在低频区域内的噪声大小非常接近, 高频和低频的过度区域则把大小接近的噪声给分割开了, 导致了块状效果.

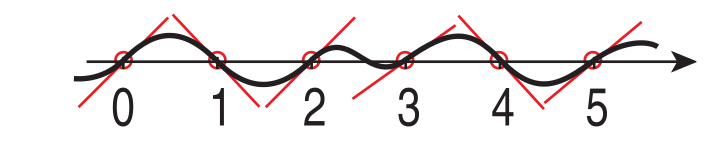

在 1D 噪声函数中, 梯度噪声算法很好控制着 1D 噪声函数图像的形状, 并且让形状成规律.

Figure 19: 1D梯度噪声的函数图像, 梯度向量控制着噪声函数形状 (图片来源: Stefan Gustavson - Simplex Noise Demystified)

这里借助 1D 梯度函数的实现来介绍一下它是如何控制函数图像的,

首先, \(a\) 和 \(b\) 分别是 \(p\) 和 \(p + 1\) 上的梯度: \(\begin{equation*} \begin{cases} a = rand(floor(p)) \times 2 - 1 \\ b = rand(floor(p) + 1) \times 2 - 1 \end{cases} \end{equation*}\),

\(f = \frac{p - floor(p)}{floor(p) + 1 - floor(p)} = p - floor(p) = fract(p)\), \(f \in [0, 1]\).

从 \(floor(p)\) 到 \(p\) 的角指向为 \(f\), 从 \(floor(p) + 1\) 到 \(p\) 的角指向为 \(f - 1\),

所以在 \(floor(p)\) 上的噪声值为 \(a \cdot f\), 在 \(floor(p) + 1\) 上的噪声值为 \(b \cdot (f - 1)\),

以下是根据两个噪声值进行插值来得出 \(p\) 上的噪声值的过程:

\(u = 3f^2 - 2f^3\), 由于 \(f \in [0, 1]\), 所以 \(u \in [0, 1]\),

设 \(P\) 是以 \(f\) 为参数的噪声函数, 那么其定义为:

\(\begin{equation*}\begin{aligned} P(f) &= a \cdot f \cdot (1 - u) + b \cdot (f - 1) \cdot u \\ &= a \cdot f + [(b - a) \cdot f - b] \cdot u \\ &= a \cdot f + (b - a) \cdot (3 f^3 - 2 f^4) - b \cdot (3 f^2 - 2 f^3) \end{aligned}\end{equation*}\)

其一阶导数为: \(P^{'}(f) = a + (b - a) \cdot (9 f^2 - 8 f^3) - b \cdot (6 f - 6 f^2)\).

根据函数定义, 函数图像在整数点上的值是 \(P(0) = P(1) = 0\), 即具备周期性;

整数点上的斜率就是它们对应的梯度: \(P^{'}(0) = a\) 以及 \(P^{'}(1) = b\).

由于一元偶数次函数的图像就是抛物线, 所以 \(P\) 是一个具备周期性的抛物线,

因此函数图由多个抛物线组成, 使得梯度噪声相比值噪声减少低频, 消除了块状效果.

同时也说明了为什么角指向不应该为单位向量, 因为按照定义 \(f = f - 1 = 1\) 是不可能成立的.

单形噪声

以下内容参考以下论文进行总结:

Stefan Gustavson - Simplex Noise Demystified

Ian McEwan, Stefan Gustavson - Efficient Computational Noise In GLSL, 2012

Kristian Nielsen - Understanding skew factors in Simplex/Improved Perlin Noise, 2015

Ian McEwan, Stefan Gustavson - Tiling Simplex Noise and Flow Noise in Two and Three Dimensions, 2022

在 2001 年, Ken Perlin 开发出了另一种名为单形噪声(simplex noise)的噪声算法, 相比前面的算法, 单形噪声算法有以下优点:

- 拥有更低的计算复杂性和更少的乘法运算

- 能以低计算成本拓展到更高维度的噪声

- 没有明显方向性的人工痕迹

- 拥有计算简单且明确的连续梯度

- 在硬件上更容易实现

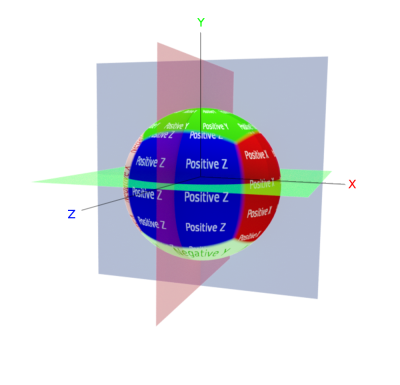

- 单形

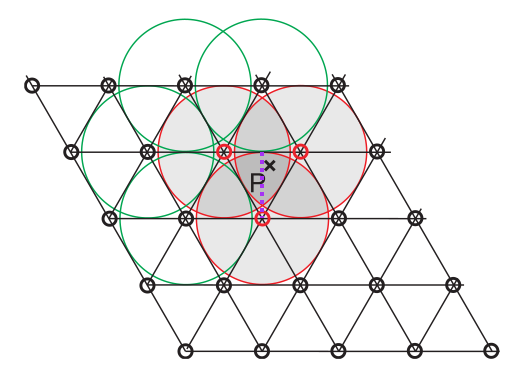

在可视化空间时, 会用选择一种几何图形来重复地对空间进行填充, 或说, 选择一种几何图形对空间进行细分(

tesselation), 从而形成坐标网格.为了方便说明, 这里把正交空间上的网格叫做正交网格, 单形空间上的网格叫做单形网格.

在细分一些空间时, 几何图形的选择会有很多种, 而几何结构最简单的那一种选择就叫做单形(

simplex shape), 也可以理解为空间的单位.一维空间的单形是等长的线段(一维空间只有这种选择).

对于二维空间, 通常会用正方形对它进行细分, 但正方形本身就能够划分成两个三角形.

因此, 三角形才是二维空间的单形, 二维空间的最优单形是等边三角形, 这意味着要把正方形沿着主对角线 \(y = x\) 错切成菱形, 使得划分所得的三角形等边, 2 个等边三角形可以组合成一个菱形.

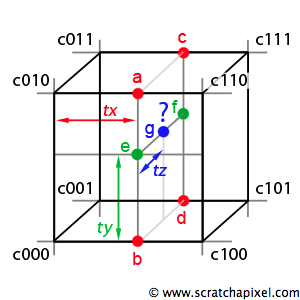

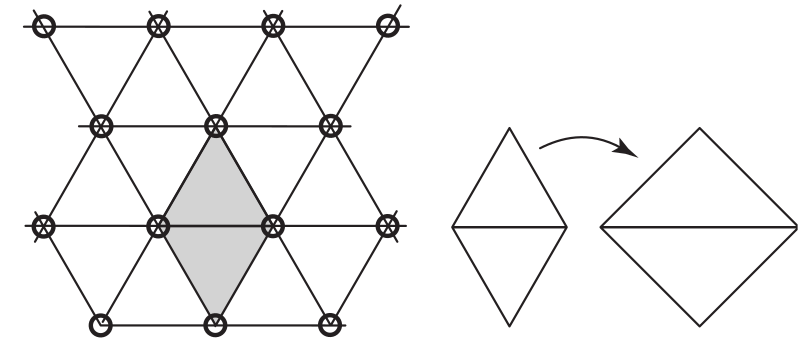

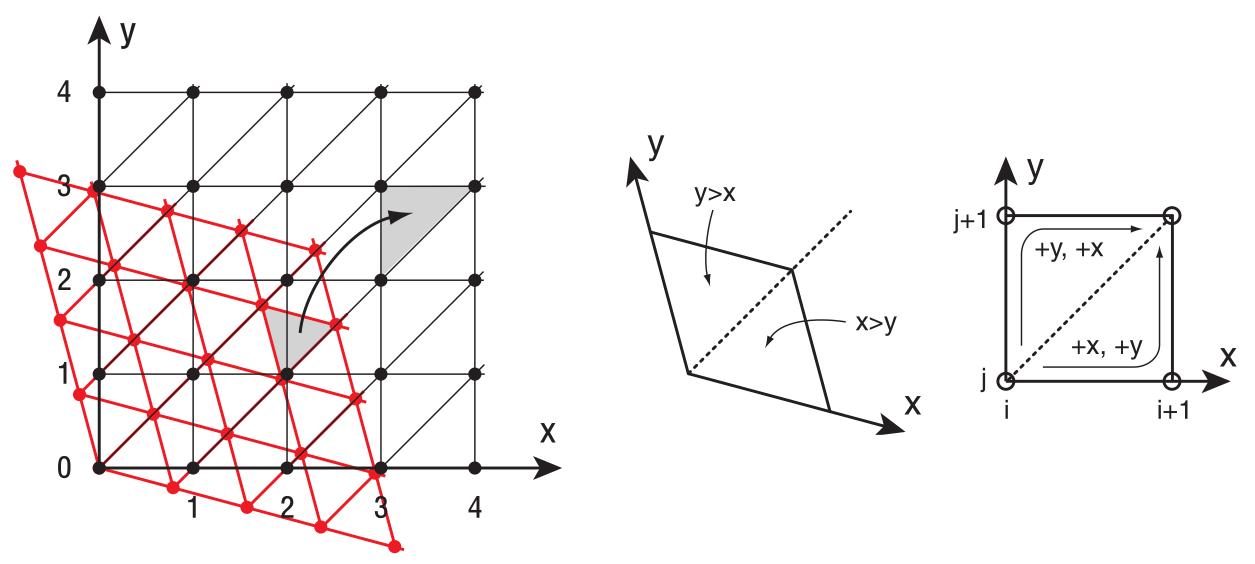

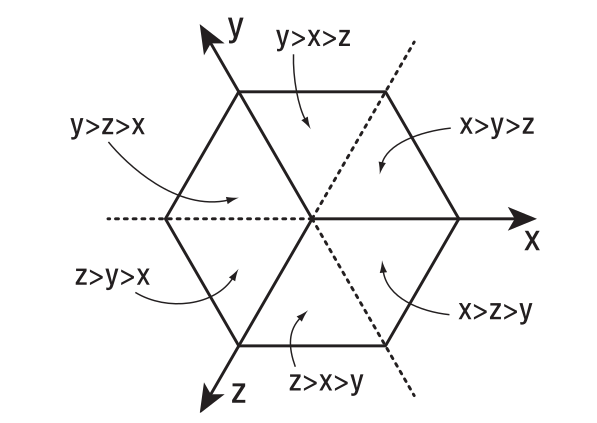

Figure 20: 等边三角形作为单形, 填充二维空间

对于三维空间, 它的单形是四面体(

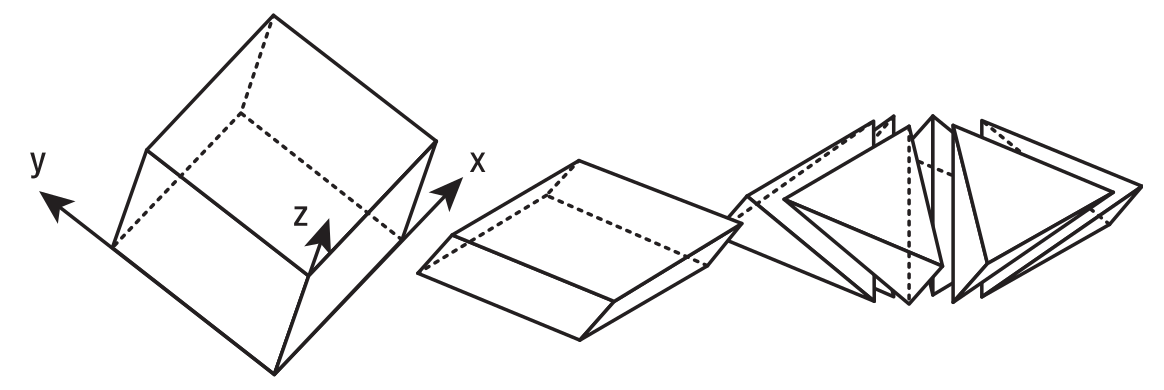

tetrahedron), 正式来说应该是正四面体, 可通过把对立方体沿着主对角线 \(x = y = z\) 进行错切, 再根据对角线划分得到 6 个正四面体.

Figure 21: 正四面体作为单形, 填充三维空间

对于四维空间, 它的单形很难可视化, 不过它有 5 个角, 并且 24 个单形可以组合成一个错切的四维超立方体(

hypercube).总的来说, \(N\) 维空间的单形有 \(N + 1\) 个角, \(N!\) 个单形可以填充完一个有着 \(2^{N}\) 个角的错切 \(N\) 维超立方体.

在传统噪声算法中, 随着走向更高维度, 为每个角计算随机梯度是一个复杂度为 \(O(2^{N})\) 的问题,

如果是对单形的每个角度计算随机梯度, 那么计算复杂度会变成 \(O(N^2)\), 这就是单形的好处.

- 用求和替代插值

随着维度走高, 传统噪声函数除了计算复杂度变高外, 噪声函数的解析导数也会越来越难求解, 噪声函数的解析导数有很多用处:

包括凹凸贴图(

bump mapping), 位移贴图(displacement mapping), 解析抗锯齿(analytical antialiasing)以及使用旋度噪声(curl nosie)的粒子动画.为了解决这个问题, 单形噪声不再像梯度噪声那样根据两角的贡献值进行插值, 而是对每个角的贡献值进行求和作为噪声值.

在单形噪声中, 角的贡献值的计算过程如下:

\([\max(0, r^2 - |\vec{d}|^2)]^4 \times \vec{d} \cdot \vec{g}\), 其中 \(\vec{d}\) 是角指向, \(\vec{g}\) 是梯度值, \(\max(0, r^2 - |\vec{d}|^2)\) 是衰减函数, \(|\vec{d}|^2\) 是角指向的模长.

衰减函数让贡献值随着点与角之间的距离增大而减少, 通常 \(r^2 = 0.5\), 也就是以角为圆心且半径为 \(\sqrt{0.5} \approx 0.7\) 的圆,

一般来说不会让这个圆覆盖同一个单形里的其它单形角, 因此, 半径 \(r\) 应该设定为等边三角形的高, 而不是等边三角形的边长.

在后面的实现二维单形噪声时会详细说明为什么是 \(r^2 = 0.5\).

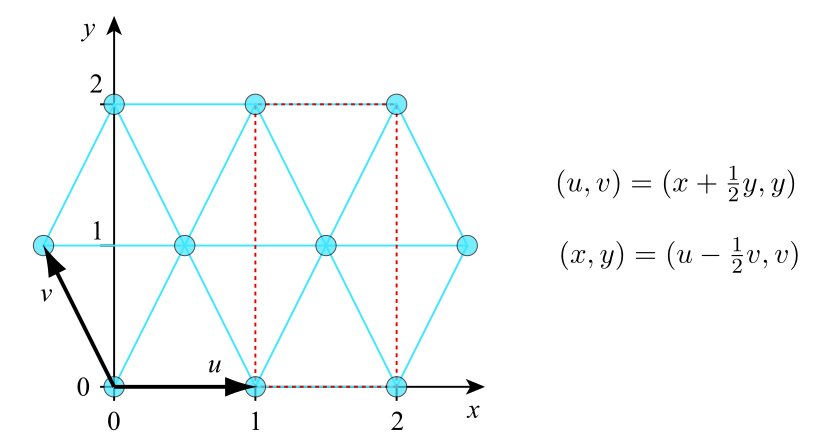

- 决定点所处的单形, 并且决定角的遍历顺序

在传统噪声算法中需要判断点处于哪个网格中, 在单形噪声算法中则需要判断点处于哪个单形中.

二维空间的单行是由菱形划分的等边三角形, 分上三角形和下三角形, 判断点在那个单形也就是判断它在上三角形还是下三角形.

在二维空间上, 如果点 \((x ,y)\) 满足 \(x \gt y\), 那么点处在下三角形中; 反之, 点处在上三角形中.

如果点处于下三角形中, 那么它的单形角的遍历顺序为 \((0, 0)\), \((1, 0)\) 和 \((1, 1)\).

如果点处于上三角形中, 那么它的单形角的遍历顺序为 \((0, 0)\), \((0, 1)\) 和 \((1, 1)\).

决定这个顺序很简单, 为了说明, 这里采用 \((i, j)\) 来作为单形的相对角坐标:

要对点 \((x, y)\) 的分量进行从大到小排序, 这个顺序决定了角相对坐标分量加 1 的顺序.

如果点的分量顺序是 \(x \gt y\), 那么是对上一个角相对坐标 \(a\) 的 \(i\) 分量先加 1, 得到角相对坐标 \(b\), 然后相对 \(b\) 的 \(j\) 分量加 1, 得到角相对坐标 \(c\):

\(a = (i, j), b = (i + 1, j), c = (i + 1, j + 1)\).

如果点的分量顺序是 \(y \gt z\), 那么是对上一个角相对坐标 \(a\) 的 \(j\) 分量先加 1, 得到角相对坐标 \(b\), 然后相对 \(b\) 的 \(i\) 分量加 1, 得到角相对坐标 \(c\):

\(a = (i, j), b = (i, j + 1), c = (i + 1, j + 1)\).

对于更高空间的点 \((x, y, \dots)\) 和角相对坐标 \((x, y, \dots)\) 同理.

下图是三维空间中判断所处单形的方法.

- 2D 单形噪声实现

这里是解读

Simplex Noise Demystified原文中2D Simplex Noise的实现:// 2D simplex noise public static double noise(double xin, double yin) { double n0, n1, n2; // Noise contributions from the three corners // Skew the input space to determine which simplex cell we're in final double F2 = 0.5*(Math.sqrt(3.0)-1.0); double s = (xin+yin)*F2; // Hairy factor for 2D int i = fastfloor(xin+s); int j = fastfloor(yin+s); final double G2 = (3.0-Math.sqrt(3.0))/6.0; double t = (i+j)*G2; double X0 = i-t; // Unskew the cell origin back to (x,y) space double Y0 = j-t; double x0 = xin-X0; // The x,y distances from the cell origin double y0 = yin-Y0; // For the 2D case, the simplex shape is an equilateral triangle. // Determine which simplex we are in. int i1, j1; // Offsets for second (middle) corner of simplex in (i,j) coords if(x0>y0) {i1=1; j1=0;} // lower triangle, XY order: (0,0)->(1,0)->(1,1) else {i1=0; j1=1;} // upper triangle, YX order: (0,0)->(0,1)->(1,1) // A step of (1,0) in (i,j) means a step of (1-c,-c) in (x,y), and // a step of (0,1) in (i,j) means a step of (-c,1-c) in (x,y), where // c = (3-sqrt(3))/6 double x1 = x0 - i1 + G2; // Offsets for middle corner in (x,y) unskewed coords double y1 = y0 - j1 + G2; double x2 = x0 - 1.0 + 2.0 * G2; // Offsets for last corner in (x,y) unskewed coords double y2 = y0 - 1.0 + 2.0 * G2; // Work out the hashed gradient indices of the three simplex corners int ii = i & 255; int jj = j & 255; int gi0 = perm[ii+perm[jj]] % 12; int gi1 = perm[ii+i1+perm[jj+j1]] % 12; int gi2 = perm[ii+1+perm[jj+1]] % 12; // Calculate the contribution from the three corners double t0 = 0.5 - x0*x0-y0*y0; if(t0<0) n0 = 0.0; else { t0 *= t0; n0 = t0 * t0 * dot(grad3[gi0], x0, y0); // (x,y) of grad3 used for 2D gradient } double t1 = 0.5 - x1*x1-y1*y1; if(t1<0) n1 = 0.0; else { t1 *= t1; n1 = t1 * t1 * dot(grad3[gi1], x1, y1); }double t2 = 0.5 - x2*x2-y2*y2; if(t2<0) n2 = 0.0; else { t2 *= t2; n2 = t2 * t2 * dot(grad3[gi2], x2, y2); } // Add contributions from each corner to get the final noise value. // The result is scaled to return values in the interval [-1,1]. return 70.0 * (n0 + n1 + n2); }

这段代码远没有作者口中的那么可读, 很多细节都没有说明, 不过确实如他所说的很方便的移植到其它语言上.

不过也不能怪作者, 因为原本

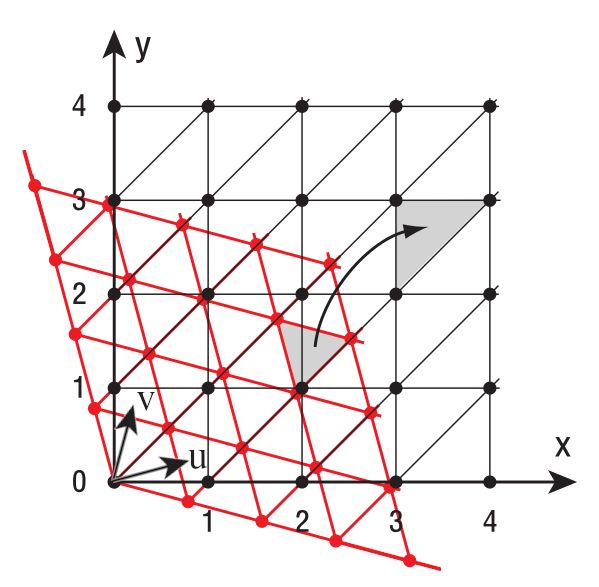

Ken Perlin的实现就很难理解了.- 把正交网格变换成单形网格

在实现单形噪声时, 可以 自由 选择使用任何单形网格, 这里选择了

Simplex Noise Demystified里的单形网格, 如下图:

这个单形网格是这么得到的:

把 \(x\) 轴 \(\left( \begin{array}{c} 1 \\ 0 \end{array} \right)\) 往逆时针方向旋转 \(15^{\circ}\) 得到 \(u\) 轴, 再把 \(y\) 轴 \(\left( \begin{array}{c} 0 \\ 1 \end{array} \right)\) 往顺时针方向旋转 \(15^{\circ}\) 得到 \(v\) 轴, 使得 \(u\) 和 \(v\) 两轴之间的夹角为 \(60^{\circ}\); 最后对 \(u\) 和 \(v\) 两轴进行统一伸缩.

这个结论是通过

Simplex Noise Demystified以下代码反推的, 原文没有明确说明如何得到的单形网格, 因此, 结论可能有误.final double F2 = 0.5*(Math.sqrt(3.0)-1.0); double s = (xin+yin)*F2; // Hairy factor for 2D int i = fastfloor(xin+s); int j = fastfloor(yin+s); final double G2 = (3.0-Math.sqrt(3.0))/6.0; double t = (i+j)*G2; double X0 = i-t; // Unskew the cell origin back to (x,y) space double Y0 = j-t; double x0 = xin-X0; // The x,y distances from the cell origin double y0 = yin-Y0;

为了方便讨论, 假设 \(\vec{u} = \left( \begin{array}{c} a \\ c \end{array} \right)\) 和 \(\vec{v} = \left( \begin{array}{c} b \\ d \end{array} \right)\) 就是旋转得到的 \(u\) 和 \(v\) 轴, 并且都是单位向量.

接下来计算得出 \(u\) 和 \(v\) 的矩阵:

\(\cos \frac{\pi}{12} = \cos(\frac{\pi}{4} - \frac{\pi}{6}) = \cos\frac{\pi}{4} \cos\frac{\pi}{6} + \sin\frac{\pi}{4} \sin\frac{\pi}{6} = \frac{\sqrt{3}}{2 \sqrt{2}} + \frac{1}{2 \sqrt{2}} = \frac{1}{2 \sqrt{2}}(\sqrt{3} + 1)\)

\(\cos (-\frac{\pi}{12}) = \cos(\frac{\pi}{6} - \frac{\pi}{4}) = \cos\frac{\pi}{6}\cos\frac{\pi}{4} + \sin\frac{\pi}{6}\sin\frac{\pi}{4} = \frac{\sqrt{3}}{2 \sqrt{2}} + \frac{1}{2 \sqrt{2}} = \frac{1}{2 \sqrt{2}}(\sqrt{3} + 1)\)

\(\sin \frac{\pi}{12} = \sin(\frac{\pi}{4} - \frac{\pi}{6}) = \sin\frac{\pi}{4} \cos\frac{\pi}{6} - \cos\frac{\pi}{4} \sin\frac{\pi}{6} = \frac{\sqrt{3}}{2 \sqrt{2}} - \frac{1}{2 \sqrt{2}} = \frac{1}{2 \sqrt{2}}(\sqrt{3} - 1)\)

\(\sin (-\frac{\pi}{12}) = \sin(\frac{\pi}{6} - \frac{\pi}{4}) = \sin\frac{\pi}{6} \cos\frac{\pi}{4} - \cos\frac{\pi}{6} \sin\frac{\pi}{4} = \frac{1}{2 \sqrt{2}} - \frac{\sqrt{3}}{2 \sqrt{2}} = \frac{1}{2 \sqrt{2}}(1 - \sqrt{3})\)

\(R(\frac{\pi}{12}) = \left( \begin{array}{c} \cos(\frac{\pi}{12}) & -\sin(\frac{\pi}{12}) \\ \sin(\frac{\pi}{12}) & \cos(\frac{\pi}{12}) \end{array} \right) = \frac{1}{2 \sqrt{2}} \left( \begin{array}{c} \sqrt{3} + 1 & 1 - \sqrt{3} \\ \sqrt{3} - 1 & \sqrt{3} + 1 \end{array} \right)\)

\(R(-\frac{\pi}{12}) = R(\frac{\pi}{12})^{-1} = R(\frac{\pi}{12})^{T}\)

\(\vec{x}\) 轴变换得到 \(\vec{u}\) 轴: \(\vec{u} = R(\frac{\pi}{12}) \left( \begin{array}{c} 1 \\ 0 \end{array} \right) = \frac{1}{2\sqrt{2}}\left( \begin{array}{c} \sqrt{3} + 1 \\ \sqrt{3} - 1 \end{array} \right)\).

\(\vec{y}\) 轴变换得到 \(\vec{v}\) 轴: \(\vec{v} = R(-\frac{\pi}{12}) \left( \begin{array}{c} 0 \\ 1 \end{array} \right) = \frac{1}{2\sqrt{2}} \left(\begin{array}{c} \sqrt{3} - 1 \\ \sqrt{3} + 1 \end{array} \right)\).

所以, 可以得出 \(\begin{equation*} \begin{cases} a = d = \frac{1}{2\sqrt{2}}(\sqrt{3} + 1) \\ b = c = \frac{1}{2\sqrt{2}}(\sqrt{3} - 1) \\ \end{cases} \end{equation*}\), 这个变换可以用矩阵 \(M_{r} = \frac{1}{2\sqrt{2}} \left( \begin{array}{c} \sqrt{3} + 1 & \sqrt{3} - 1 \\ \sqrt{3} - 1 & \sqrt{3} + 1 \end{array} \right)\) 表示.

仅凭这些是没办法看出与代码有什么关系, 这是因为文中代码做了性能优化,

非常感谢

Kristian Nielsen的贡献, 不然破头也想不出来.先来看一下从 \(xy\) 到 \(uv\) 之间变换: \(\begin{equation*} \begin{cases} u = ax + by \\ v = cx + dy \end{cases} \end{equation*}\), 因为 \(a = d\) 并且 \(b = c\), 所以该关系可以写成 \(\begin{equation*} \begin{cases} u = ax + by \\ v = bx + ay \end{cases} \end{equation*}\).

整个变换需要 4 次乘法, 文中引入 "Fancy version of zero" 对变换进行重组得到: \(\begin{equation*} \begin{cases} u = ax - bx + bx + by = (a - b)x + b(x + y) \\ v = bx - by + by + ay = (a - b)y + b(x + y) \end{cases} \end{equation*}\),

其中 \(b(x + y)\) 是重复运算, 可以减少 1 次乘法运算; 再使得 \(a - b = 1\), 则可以再去掉 2 次乘法运算 \(\begin{cases} (a - b)x \\ (a - b)y \end{cases}\),

那么整个变换只需要 1 次乘法运算 \(b(x + y)\).

因为 \(a - b = \frac{\sqrt{2}}{2}\), 所以只要让 \(a\) 和 \(b\) 同时除以 \(\frac{\sqrt{2}}{2}\) 或乘以 \(\sqrt{2}\) 即可使得 \(a - b = 1\), 对应了开头说的统一缩放变换,

可以用矩阵 \(M_{s} = \sqrt{2} \left( \begin{array}{c} 1 & 0 \\ 0 & 1 \end{array} \right)\) 表示.

同时说明了最终的单形网格空间的基向量并非单位向量: \(\begin{equation*} \begin{cases} \sqrt{2} \times \frac{1}{2\sqrt{2}} = \frac{1}{2} \\ a_{1} = d_{1} = \frac{1}{2}(\sqrt{3} + 1) \\ b_{1} = c_{1} = \frac{1}{2}(\sqrt{3} - 1) \end{cases} \end{equation*}\).

再回过头来对比整个变换过程 \(M = M_{s}M_{r}\) 和上面的代码, 其中 \(b_{1}(x + y)\) 对应 \(\mathrm{(xin + yin) * F2}\), 并且 \(b_{1} = \mathrm{F2} = \frac{\sqrt{3} - 1}{2}\).

把单形网格空间上的点还原到正交网格上, 就是求 \(M\) 的逆矩阵 \(M^{-1} = M_{r}^{-1}M_{s}^{-1} = \left( \begin{array}{c} a_2 & b_2 \\ c_2 & d_2 \end{array} \right)\),

该变换也可以像上面那样写成: \(\begin{equation*} \begin{cases} x = a_{2}u - b_{2}u + b_{2}u + b_{2}v = (a_{2} - b_{2})u + b_{2}(u + v) \\ y = b_{2}u - b_{2}v + b_{2}v + a_{2}v = (a_{2} - b_{2})v + b_{2}(u + v) \end{cases} \end{equation*}\).

\(M_{s}^{-1} = \frac{\sqrt{2}}{2} \left( \begin{array}{c} 1 & 0 \\ 0 & 1 \end{array} \right)\)

\(M_{r}^{-1} = \frac{1}{ad - bc} \left( \begin{array}{c} d & -c \\ -b & a \end{array} \right) = \frac{1}{\sqrt{6}} \left( \begin{array}{c} \sqrt{3} + 1 & 1 - \sqrt{3} \\ 1 - \sqrt{3} & \sqrt{3} + 1 \end{array} \right)\)

\(M^{-1} = M_{r}^{-1}M_{s}^{-1} = \frac{\sqrt{2}}{2} \times \frac{1}{\sqrt{6}} \left( \begin{array}{c} \sqrt{3} + 1 & 1 - \sqrt{3} \\ 1 - \sqrt{3} & \sqrt{3} + 1 \end{array} \right) = \frac{1}{2\sqrt{3}} \left( \begin{array}{c} \sqrt{3} + 1 & 1 - \sqrt{3} \\ 1 - \sqrt{3} & \sqrt{3} + 1 \end{array} \right)\)

所以, 得出 \(\begin{equation*} \begin{cases} a_{2} = d_{2} = \frac{\sqrt{3} + 1}{2\sqrt{3}} = \frac{3 + \sqrt{3}}{6} \\ b_{2} = c_{2} = \frac{1 - \sqrt{3}}{2 \sqrt{3}} = \frac{\sqrt{3} - 3}{6} \end{cases} \end{equation*}\), 对比代码中的 \(\mathrm{(i + j) * G2}\) 可发现 \(-b_2 = \mathrm{G2} = \frac{3 - \sqrt{3}}{6}\),

为什么是转负, 因为代码的上下文是这样的:

double t = (i + j) * G2; double X0 = i - t; double Y0 = j - t;

\(i\) 和 \(j\) 是单形中第一个被遍历到的角相对坐标 \((0, 0)\) 的分量, \((\mathrm{X0}, \mathrm{Y0})\) 是该单形角对应的正交网格空间坐标, \((\mathrm{x0}, \mathrm{y0})\) 是单形角正交网格空间中上的角指向, 同时是点在单形中的相对坐标.

到了这里就开始进入下一个环节了: 遍历单形角.

Ian McEwan和Stefan Gustavson后来又写了Tiling Simplex Noise and Flow Noise in Two and Three Dimensons, 里面采用了另一种方便计算的二维单形网格, 不过它的单形并非等边的等腰三角形:

这个单形也提高了后续遍历单形角的计算效率.

- 遍历单形角并求和贡献值

// For the 2D case, the simplex shape is an equilateral triangle. // Determine which simplex we are in. int i1, j1; // Offsets for second (middle) corner of simplex in (i,j) coords if(x0>y0) {i1=1; j1=0;} // lower triangle, XY order: (0,0)->(1,0)->(1,1) else {i1=0; j1=1;} // upper triangle, YX order: (0,0)->(0,1)->(1,1) // A step of (1,0) in (i,j) means a step of (1-c,-c) in (x,y), and // a step of (0,1) in (i,j) means a step of (-c,1-c) in (x,y), where // c = (3-sqrt(3))/6 double x1 = x0 - i1 + G2; // Offsets for middle corner in (x,y) unskewed coords double y1 = y0 - j1 + G2; double x2 = x0 - 1.0 + 2.0 * G2; // Offsets for last corner in (x,y) unskewed coords double y2 = y0 - 1.0 + 2.0 * G2;

首先是判断点位于哪个单形中, 这里通过点 \(\mathrm{(x0, y0)}\) 在正交网格空间的分量进行判断,

如果 \(\mathrm{x0} \gt \mathrm{y0}\) 就是菱形的下三角形, 否则就是上三角形.

因为第二个单形角的相对坐标是 \((0, 1)\) 或 \((1, 0)\), 代码中的 \(\mathrm{x1 = x0 - i1 + G2}\) 完整写法是 \(\mathrm{x0 - [i1 - (1 + 0) \times G2]}\),

表示第二个单形角在正交网格空间上的角指向 \(x\) 分量, 同理, \(\mathrm{y1}\) 表示对应的 \(y\) 分量.

因此, \((\mathrm{x1}, \mathrm{y1})\) 是第二个单形角在正交网格空间上的角指向.

第三个单形角的相对坐标是 \((1, 1)\) 代码中的 \(\mathrm{x2 = x0 - 1 + 2 \times G2}\) 完整写法是 \(\mathrm{x2 = x0 - [1 - (1 + 1) \times G2]}\),

其中 \(\mathrm{1 - (1 + 1) \times G2}\) 是该单形角的 \(x\) 分量, 所以 \(\mathrm{x2}\) 表示第三个单形角在正交网格空间上的角指向 \(x\) 分量; 同理, \(\mathrm{y2}\) 是对应的 \(y\) 分量.

因此, \((\mathrm{x2}, \mathrm{y2})\) 是第三个单形角在正交网格空间上的角指向.

在计算出所有角指向后, 可以开始计算每个角的贡献值了, 下面是原文中的参考代码:

// Calculate the contribution from the three corners double t0 = 0.5 - x0*x0-y0*y0; if(t0<0) n0 = 0.0; else { t0 *= t0; n0 = t0 * t0 * dot(grad3[gi0], x0, y0); // (x,y) of grad3 used for 2D gradient } double t1 = 0.5 - x1*x1-y1*y1; if(t1<0) n1 = 0.0; else { t1 *= t1; n1 = t1 * t1 * dot(grad3[gi1], x1, y1); } double t2 = 0.5 - x2*x2-y2*y2; if(t2<0) n2 = 0.0; else { t2 *= t2; n2 = t2 * t2 * dot(grad3[gi2], x2, y2); } // Add contributions from each corner to get the final noise value. // The result is scaled to return values in the interval [-1,1]. return 70.0 * (n0 + n1 + n2);